Vi kontaktede Sony for at prøve at lære lidt mere om IMX378-sensoren, der bruges af de kommende Google Pixel- og Pixel XL-telefoner. Lær alt om det!

IMX378 Oversigt

Vi kontaktede Sony for at prøve at lære lidt mere om IMX378-sensoren, der bruges af den kommende Google Pixel og Pixel XL telefoner, samt af Xiaomi Mi 5S. Desværre var Sony ikke i stand til at distribuere dataarket for Exmor RS IMX378 sensoren endnu, men de var yderst hjælpsomme og var i stand til at give os nogle tidligere ikke-udgivne oplysninger om IMX378.

For det første var selve navnet forkert. På trods af rygter om, at det ville være en del af Exmor R linje af Backside Illuminated (BSI) CMOS-sensorer som IMX377 før den, der blev brugt i Nexus 5X og Nexus 6P, vores kontakt hos Sony har informeret os om, at IMX378 i stedet vil blive betragtet som en del af Sonys Exmor RS linje af stablede BSI CMOS-sensorer.

Mens mange ting er forblevet de samme fra IMX377 til IMX378, inklusive pixelstørrelsen (1,55 μm) og sensorstørrelsen (7,81 mm), er der tilføjet et par nøglefunktioner. Det er nemlig nu et stablet BSI CMOS-design, det har PDAF, det tilføjer Sonys SME-HDR-teknologi, og det har bedre understøttelse af video med høj billedhastighed (slowmotion).

Stablet BSI CMOS

Bagsidebelysning i sig selv er en yderst nyttig funktion, der er blevet næsten standard i flagskibssmartphones i de sidste par år, startende med HTC Evo 4G i 2010. Det giver kameraet mulighed for at fange væsentligt mere lys (på bekostning af mere støj) ved at flytte noget af det strukturen, der traditionelt sad foran fotodioden på forreste belyste sensorer, bagved det.

Overraskende nok, i modsætning til de fleste kamerateknologier, begyndte bagsidebelysning oprindeligt at dukke op i telefoner før DSLR'er, i høj grad på grund af vanskelighederne med at skabe større BSI-sensorer. Den første BSI APS-C sensor var Samsung S5KVB2, der blev fundet i deres NX1 kamera fra 2014, og den første full-frame sensor var Sony Exmor R IMX251, der blev fundet i Sony α7R II fra sidst år.

Stacked BSI CMOS-teknologi tager dette et skridt videre ved at flytte mere af kredsløbet fra det forreste lag til det understøttende substrat bag fotodioderne. Dette gør det ikke kun muligt for Sony at reducere størrelsen af billedsensoren væsentligt (hvilket giver mulighed for større sensorer i samme fodaftryk), men giver også Sony mulighed for at udskrive pixels og kredsløb separat (selv på forskellige fremstillingsprocesser), hvilket reducerer risikoen for defekter, forbedrer udbyttet og giver mulighed for mere specialisering mellem fotodioderne og de understøttende kredsløb.

PDAF

IMX378 tilføjer Phase Detection Autofocus, som sidste års Nexus-telefoner og IMX377 ikke understøttede. Det giver kameraet mulighed for effektivt at bruge forskellene i lysintensitet mellem forskellige punkter på sensoren til at identificere hvis objektet, som kameraet forsøger at fokusere på, er foran eller bagved fokuspunktet, og juster sensoren derfor. Dette er en enorm forbedring både hvad angår hastighed og nøjagtighed i forhold til den traditionelle kontrastbaserede autofokus, som vi tidligere har set på mange kameraer. Som et resultat heraf har vi set en absolut eksplosion af telefoner, der bruger PDAF, og det er blevet et enormt marketing-buzzword, der holdes frem som et centralt element i kameramarkedsføring på tværs af branchen.

IMX378 tilføjer Phase Detection Autofocus, som sidste års Nexus-telefoner og IMX377 ikke understøttede. Det giver kameraet mulighed for effektivt at bruge forskellene i lysintensitet mellem forskellige punkter på sensoren til at identificere hvis objektet, som kameraet forsøger at fokusere på, er foran eller bagved fokuspunktet, og juster sensoren derfor. Dette er en enorm forbedring både hvad angår hastighed og nøjagtighed i forhold til den traditionelle kontrastbaserede autofokus, som vi tidligere har set på mange kameraer. Som et resultat heraf har vi set en absolut eksplosion af telefoner, der bruger PDAF, og det er blevet et enormt marketing-buzzword, der holdes frem som et centralt element i kameramarkedsføring på tværs af branchen.

Selvom det ikke er helt så hurtigt at fokusere som Dual Photodiode PDAF, der Samsung Galaxy S7 har (også kendt som "Dual Pixel PDAF" og "Duo Pixel Autofokus"), som gør det muligt at bruge hver enkelt pixel til fasedetektion ved at inkludere to fotodioder pr. pixel, bør sammenlægningen af PDAF og laserautofokus stadig være en potent kombination.

Høj billedhastighed

Der har været meget snak på det seneste om kameraer med høj billedhastighed (både til forbrugerapplikationer og i professionel filmproduktion). At være i stand til at optage ved højere billedhastigheder kan bruges både til at skabe utroligt glatte videoer ved almindelig hastighed (som kan være fantastisk til sport og andre højhastighedsscenarier) og for at skabe nogle virkelig interessante videoer når du bremser alting.

Desværre er det ekstremt svært at optage video ved højere billedhastigheder, og selv når dit kamera sensor kan optage ved højere billedhastigheder, kan det være svært for telefonens billedsignalprocessor at holde op. Det er derfor, mens IMX377 brugt i Nexus 5X og 6P kunne optage 720p video ved 300 Hz og 1080p video ved 120 Hz, så vi kun 120 Hz 720p fra Nexus 5X og 240 Hz 720p fra 6P. IMX377 var også i stand til 60 Hz 4k video, på trods af at Nexus-enhederne var begrænset til 30 Hz.

Pixel-telefonerne er både i stand til at bringe denne op til 120 Hz 1080p video og 240 Hz 720p video takket være del til forbedringer relateret til IMX378, som ser en stigning i kapaciteter på op til 240 Hz ved 1080p.

Sensoren er også i stand til at skyde burst-billeder i fuld opløsning hurtigere, idet den går op til 60 Hz ved 10 bit output og 40 Hz ved 12 bit output (op fra henholdsvis 40 Hz og 35 Hz), hvilket skulle hjælpe med at reducere mængden af bevægelsessløring og kamerarystelser, når du bruger HDR+.

SME-HDR

Traditionelt har HDR til video været en afvejning. Du skulle enten halvere billedhastigheden, eller også skulle du halvere opløsningen. Som et resultat har mange OEM'er ikke engang gidet det, hvor Samsung og Sony er blandt de få, der implementerer det. Selv Samsung Galaxy Note 7 er begrænset til 1080p 30 Hz-optagelse på grund af til dels de store beregningsomkostninger ved HDR-video.

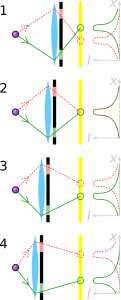

Den første af de to vigtigste traditionelle metoder til HDR-video, som Red Digital Cinema Camera Company kalder HDRx og som Sony kalder Digital Overlap HDR (DOL-HDR), fungerer ved at tage to på hinanden følgende billeder, et eksponeret mørkere og et eksponeret lysere, og flette dem sammen for at skabe en enkelt videoramme. Mens dette giver dig mulighed for at beholde kameraets fulde opløsning (og indstille forskellige lukkertider for de to separate rammer), kan det ofte resultere i problemer på grund af tidsforskellen mellem de to billeder (især med hurtig bevægelse genstande). Derudover kan det være meget svært for processoren at følge med, da med DOL-HDR håndterer telefonens internetudbyder at flette de separate rammer sammen.

Den anden traditionelle metode, som Sony kalder Binning Multiplexed Exposure HDR (BME-HDR), sætter en anden eksponeringsindstilling for hvert par af to linjer af pixels i sensoren for at skabe to billeder i halv opløsning på samme tid, som derefter flettes sammen til én HDR-ramme til videoen. Selvom denne metode undgår problemerne forbundet med HDRx, nemlig en reduktion i billedhastighed, har den andre problemer, specifikt reduktionen i opløsning og grænserne for, hvordan eksponeringen kan ændres mellem de to sæt af linjer.

Spatial Multiplexed Exposure (SME-HDR) er en ny metode, som Sony bruger til at give dem mulighed for at optage HDR i den fulde opløsning og med den fulde billedhastighed, som sensoren er i stand til. Det er en variant af Rumligt varierende eksponering der bruger proprietære algoritmer til at tillade Sony at fange informationen fra de mørke og lyse pixels, som er arrangeret i et skakternet mønster, og udled billedet i fuld opløsning for både mørke og lyse eksponeringer billeder.

Desværre var Sony ikke i stand til at give os mere detaljerede forklaringer om det nøjagtige mønster, og de vil muligvis aldrig være i stand til at afsløre det - virksomheder har en tendens til at spille deres kort meget tæt på deres bryst, når det kommer til banebrydende teknologi, som den, vi ser i HDR, hvor selv Google har deres egen proprietære algoritme til HDR-billeder kendt som HDR+. Der er dog stadig nogle offentligt tilgængelige oplysninger, som vi kan bruge til at sammensætte, hvordan det kan opnås. Et par artikler er blevet udgivet af Shree K. Nayar fra Columbia University (hvoraf en var i samarbejde med Tomoo Mitsunaga fra Sony), der indeholder forskellige måder at bruge Spatial Varying Exposure på, og forskellige layouts, der kan opnå det. Nedenfor er et eksempel på et layout med fire eksponeringsniveauer på en RGBG-billedsensor. Dette layout hævder at være i stand til at opnå enkeltoptagelser i fuld opløsning HDR-billeder med kun omkring 20 % tab i rumlig opløsning, afhængigt af scenariet (den samme præstation, som Sony hævder SME-HDR).

Sony har allerede brugt SME-HDR i et par billedsensorer, herunder i IMX214, der har været meget populær på det seneste (der bliver brugt i Asus Zenfone 3 Laser, den Moto Z, og Xperia X ydeevne), men er en ny tilføjelse til IMX378 sammenlignet med IMX377, der blev brugt sidste år. Det giver kamerasensoren mulighed for at udsende både 10 bit fuld opløsning og 4k video ved 60 Hz med SME-HDR aktiv. Mens en flaskehals andre steder i processen vil resultere i en lavere grænse, er dette en fantastisk forbedring i forhold til, hvad IMX377 var i stand til, og er et tegn på gode ting i fremtiden.

En af de store forbedringer af IMX378 i forhold til IMX377 er, at den er i stand til at håndtere mere af billedbehandlingen on-chip, hvilket reducerer ISP'ens arbejdsbyrde (selv om ISP'en stadig er i stand til at anmode om RAW-billeddata, afhængigt af hvordan OEM beslutter at bruge sensor). Det kan håndtere mange små ting som fejlkorrektion og spejling lokalt, men endnu vigtigere, det kan også håndtere BME-HDR eller SME-HDR uden at skulle involvere internetudbyderen. Det kan potentielt være en stor forskel fremadrettet ved at frigøre nogle overhead for internetudbyderen på fremtidige telefoner.

Vi vil gerne takke Sony endnu en gang for al hjælpen med at oprette denne artikel. Vi sætter virkelig pris på den indsats, som Sony gjorde for at sikre nøjagtigheden og dybden af dette funktion, især ved at give os mulighed for at afsløre nogle tidligere ikke-udgivne oplysninger om IMX378.

Når det er sagt, er det virkelig en skam, at det er så svært at få adgang til nogle af disse oplysninger, selv grundlæggende produktoplysninger. Når virksomheder forsøger at lægge information på deres hjemmesider, kan det ofte være ret utilgængeligt og ufuldstændigt i store træk del, fordi det ofte behandles som en sekundær bekymring for virksomhedens medarbejdere, som er mere fokuserede på deres vigtigste arbejde. En dedikeret person, der håndterer public relations, kan gøre en enorm forskel med hensyn til at lave denne type information tilgængelig og tilgængelig for den brede offentlighed, og vi ser nogle mennesker, der forsøger at gøre netop det i deres gratis tid. Selv på Sony Exmor Wikipedia-artiklen selv, hvor en enkelt person i løbet af et par måneder i deres fritid lagde det meste af grundlaget for at tage det fra en næsten ubrugelig 1.715 byte artikel som stort set havde været det samme i årevis, i artiklen omkring 50.000 byte, som vi ser der i dag med 185 forskellige redaktører. En artikel, der uden tvivl er det bedste lager af information om Sony Exmor-sensorlinjen tilgængelig online, og vi kan se et meget lignende mønster på andre artikler. En enkelt dedikeret skribent kan gøre en væsentlig forskel i, hvor let kunder kan sammenligne forskellige produkter, og i hvor uddannede interesserede forbrugere er omkring emnet, hvilket kan have vidtrækkende effekter. Men det er et emne til en anden gang.

Som altid undrer vi os over, hvordan disse hardwareændringer vil påvirke selve enhederne. Vi vil helt klart ikke få 4k 60 Hz HDR-video (og måske slet ikke få HDR-video, da Google ikke har nævnt det endnu), men den hurtigere fuld opløsning optagelse vil sandsynligvis hjælpe væsentligt med HDR+, og vi vil se forbedringerne af den nyere sensor sive ind i telefonen på andre lignende små, men væsentlige måder såvel.

Mens DXOMark viser Pixel telefoner som præsterer lidt bedre end Samsung Galaxy S7 og HTC 10, mange af de ting, der gav Pixel-telefonerne den lille forspring, var stor software forbedringer som HDR+ (som giver helt fantastiske resultater, og som DXOMark dedikerede en hel del af deres anmeldelse til) og Googles særlige EIS system (som kan arbejde sammen med OIS), der sampler gyroskopet 200 gange i sekundet for at give noget af den bedste elektroniske billedstabilisering, vi nogensinde har set. Ja, Pixel-telefonerne har et fantastisk kamera, men kunne de have været endnu bedre med OIS og Dual Pixel PDAF tilføjet? Absolut.

Misforstå mig ikke, som jeg sagde, Pixel-telefonerne har et helt fantastisk kamera, men du kan ikke rigtig bebrejde mig, at jeg vil have mere, især når vejen til disse forbedringer er så klar (og når telefonerne er prissat til fuld flagskibspris, hvor du forventer det bedste af bedst). Der vil altid være en del af mig, der vil have mere, som ønsker bedre batterilevetid, hurtigere processorer, bedre batterilevetid, lysere og mere levende skærme, højere højttalere, bedre kameraer, mere lagerplads, bedre batterilevetid og vigtigst af alt, bedre batterilevetid (en gang til). Når det er sagt, så har Pixel-telefonerne mange små fantastiske funktioner, der kunne samles for at skabe en virkelig lovende enhed, som jeg er spændt på at se.