Wie alle bisherigen iPhone-Releases bieten auch das diesjährige iPhone XS und iPhone XS Max verbesserte Kameras. Aber sie sind nicht besser, wie Sie es vielleicht erwarten.

Auf dem Papier scheinen das iPhone XS und das iPhone XS Max nicht über Kameras zu verfügen, deren Spezifikationen im Vergleich zum Flaggschiff des letzten Jahres deutlich verbessert wurden.

Aber sie werden immer noch bessere Fotos und Videos machen als das iPhone X. Hier ist der Grund.

Inhalt

- VERBUNDEN:

- Hardware-Upgrades für das iPhone XS

-

Wichtige Software-Updates für die iPhone XS-Kamera

- Apples Smart HDR für iPhone XS und XR

- Aktualisierung des Porträtmodus

- Zusammenhängende Posts:

VERBUNDEN:

- Unsere ersten Eindrücke der iPhone-Modelle 2018

- 25 Top iOS 12 Tipps, die tatsächlich funktionieren

- Was ist mit der Luftwaffe passiert? Exklusiver Versicherungsschutz

- Hier ist alles, was Apple bei der diesjährigen Veranstaltung nicht angekündigt hat und was das bedeuten könnte

Hardware-Upgrades für das iPhone XS

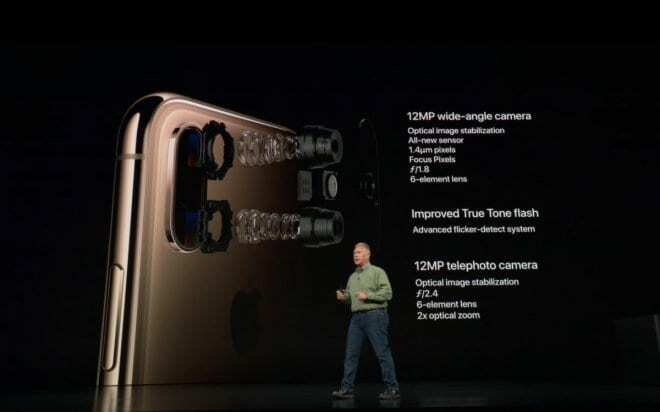

Um es klar zu sagen, Apple hat die eigentliche Kamera-Hardware des neuen iPhone Xs und iPhone Xs Max noch aktualisiert. Dazu gehört auch ein Update der Rückfahrkamera.

Obwohl es sich immer noch um einen 12-Megapixel-Sensor mit einem optisch stabilisierten f/1.8-Objektiv handelt, hat Apple die Größe des Sensors und der Megapixel erhöht

- Das bedeutet, dass sie mehr Licht sammeln und dadurch besser aussehende Fotos aufnehmen können.

- Die Frontkamera verfügt über den gleichen 7-Megapixel-Sensor mit einem f/2.2-Objektiv. (Obwohl der Sensor laut Apple jetzt „doppelt so schnell“ ist.)

- Die nach hinten gerichtete Telekamera verfügt weiterhin über einen 12-Megapixel-Sensor, ein f/2.4-Objektiv und eine optische Bildstabilisierung.

- Apple sagt auch, dass es den bereits großartigen True Tone Flash schrittweise aktualisiert hat. Dieses Update sollte eine genauere Farbwiedergabe bei schlechten Lichtverhältnissen ermöglichen.

Wichtige Software-Updates für die iPhone XS-Kamera

Neben den Hardware-Updates gibt es auch diverse softwarebasierte Updates. Diese Updates, wie auch neue Videostabilisierungsalgorithmen, verbessern im Allgemeinen die Qualität von Fotos.

Aber wenn es um wesentliche Änderungen an der Kamerafront des iPhone XS und iPhone XS Max geht, geht es hauptsächlich um zwei neue Hauptfunktionen.

Apples Smart HDR für iPhone XS und XR

Doch das mit Abstand größte Update des Kamerasystems beim iPhone XS und XS Max hat wenig mit Sensoren und Megapixeln zu tun. Stattdessen ist es meist softwarebasiert.

Das neue System heißt Smart HDR

Es ist ein Softwaresystem, das den leistungsstarken A12 Bionic von Apple nutzt. Grundsätzlich werden Fotos, die Sie aufnehmen, durch einen aktualisierten Bildsignalprozessor und die Neural Engine des A12 ausgeführt, damit sie besser aussehen.

Der eigentliche Prozess ist natürlich komplizierter. Smart HDR funktioniert wie ähnliche Systeme auf anderen Geräten und Kameras. Es nimmt eine Reihe von Bildern mit unterschiedlichen Belichtungen auf und kombiniert sie intelligent, um ein einzelnes Bild zu erstellen, das wesentlich besser aussieht.

Dadurch erhalten Ihre Bilder auch bei schlechten Lichtverhältnissen eine hohe Qualität. Im Vergleich zu Geräten, die nicht mit Smart HDR ausgestattet sind, sind sie auch im Allgemeinen heller und haben viel mehr Details.

Unterstützt durch Computerfotografie

Apple nennt diese Technologie „Computerfotografie“ – also Fotografie, die von Hightech-Rechenleistung wie der des A12 Bionic unterstützt wird. Es genügt zu sagen, dass diese Art von System ohne erstklassiges Silizium wie das A12 einfach nicht möglich ist.

Es ist eigentlich ziemlich erstaunlich, wie Smart HDR funktioniert. Sobald Sie die Kamera-App öffnen, beginnt das iPhone XS/XR mit der Aufnahme eines „Vier-Frame-Puffers“, der keine Auslöseverzögerung ermöglicht.

Smart HDR schaut sich dann diese Frames an und entscheidet, ob sie ein Foto durch Hinzufügen von Details verbessern können. Es erkennt auch intelligent Bewegungen oder Gesichter innerhalb einer Aufnahme und passt das Endergebnis entsprechend an.

Im Wesentlichen nimmt der A12 Bionic-Chip von Apple ein Foto auf und lässt es in dem Moment besser aussehen, in dem Sie es aufnehmen. Dies ist eine Funktion, die selbst Vollformatkameras nicht können, obwohl sie möglicherweise Fotos in höherer Qualität aufnehmen.

Aktualisierung des Porträtmodus

Apple hat eine ähnliche softwarebasierte Änderung am Portrait-Modus vorgenommen, der proprietären Funktion, die ermöglicht es Benutzern, ein Bild mit einem simulierten „Bokeh-Effekt“ aufzunehmen, ähnlich wie bei Fotos, die mit einer Vollformatkamera aufgenommen wurden.

Bokeh ist ein Begriff, der verwendet wird, um ein Bild mit einem hervorgehobenen Motiv und einem weich verschwommenen Hintergrund zu beschreiben. Dies ist nur eine Möglichkeit, wie Smartphone-Kamerabilder aussehen wie mit einer DSLR oder einer spiegellosen Vollformatkamera aufgenommen.

Ein Game Changer für Mobilgeräte – Manuelles Anpassen des Bokeh

Aber das iPhone XS, iPhone XS Max und das iPhone XR machen etwas Interessantes. Sie können die Hintergrundunschärfe oder das Bokeh anpassen, nachdem Sie das Bild aufgenommen haben.

Es funktioniert, indem es ein Gesicht in einem Amin erkennt und den Hintergrund und den Vordergrund trennt. Die Software von Apple erstellt auch eine „Tiefenkarte“ der Umgebung und fügt intelligent Unschärfe hinzu, um nachzuahmen, wie das Bild auf einer DSLR aussehen würde.

Apple hat dies erreicht, indem es die Unschärfe des Porträtmodus auf Vollformatkameras mit abnehmbaren Objektiven modelliert hat. Sicher, die Bildqualität ist nicht direkt vergleichbar, aber die iPhone XS (und XR)-Reihe schneidet für ein Mobilteil außergewöhnlich gut ab.

Es ist erwähnenswert, dass einige andere Geräte, wie einige von Samsung, vor Apple ähnliche Funktionen hatten. Aber das Tiefenkontrollsystem von Apple wird im Allgemeinen besser aussehen, weil es mit seiner Bildverarbeitung im Hintergrund härter arbeitet.

Darüber hinaus ist die Funktion auch bei der Frontkamera verfügbar, obwohl sie nur einen einzigen Sensor hat.

Mike ist ein freiberuflicher Journalist aus San Diego, Kalifornien.

Während er sich hauptsächlich mit Apple und Verbrauchertechnologie befasst, hat er in der Vergangenheit Erfahrung mit dem Schreiben über öffentliche Sicherheit, Kommunalverwaltung und Bildung für eine Vielzahl von Publikationen.

Er hat im Journalismus einige Hüte getragen, darunter Schriftsteller, Redakteur und Nachrichtendesigner.