Tout en regardant le discours d'ouverture de la WWDC21 il y a quelques semaines, j'ai commencé à remarquer un thème récurrent. Et ce thème est que plusieurs des fonctionnalités à venir d'iOS 15 semblent tirer parti du moteur neuronal de l'iPhone.

Le Neural Engine est présent dans l'iPhone depuis la sortie de l'iPhone X en 2017. Cependant, je ne pense pas que la plupart d'entre nous aient ressenti les effets de ce processeur au cours des quatre années écoulées depuis sa sortie initiale.

La WWDC21 n'arrêtait pas de me donner le sentiment qu'iOS 15 est la première mise à jour iOS futuriste depuis longtemps. Et, bien qu'il n'y ait pas de confirmation officielle d'Apple à ce sujet, je pense que c'est parce qu'Apple tire enfin pleinement parti du Neural Engine.

Dans cet article, je couvrirai brièvement ce qu'est le Neural Engine, puis je plongerai dans toutes les nouvelles fonctionnalités d'iOS 15 qui semblent utiliser ce processeur à son plein potentiel. Vers la fin, je couvrirai les principales façons dont iOS utilise actuellement le moteur neuronal, afin que vous puissiez le comparer à la prochaine version d'iOS 15.

Bon, allons-y !

Contenu

- Qu'est-ce que le Neural Engine sur iPhone ?

-

Comment les fonctionnalités d'iOS 15 commencent à tirer parti du moteur neuronal

- Votre iPhone peut lire le texte de vos photos

- Les fonctionnalités d'iOS 15 permettront à votre iPhone de reconnaître et d'identifier le contenu de vos photos

- Les souvenirs dans les photos vont être plus sophistiqués et plus "réels"

- Les notifications, les widgets et le mode Ne pas déranger deviennent plus intelligents

- Les nouvelles fonctionnalités d'iOS 15 faciliteront l'obtention d'itinéraires avec votre appareil photo

- Siri effectuera plus de traitement sur votre appareil

-

Que peut faire le Neural Engine sans les prochaines fonctionnalités d'iOS 15 ?

- Le moteur neuronal vous aide à prendre de meilleures photos

- L'apprentissage automatique rend FaceID rapide, sécurisé et adaptatif

- Le Neural Engine joue un rôle clé dans les expériences AR sur iPhone

-

Les prochaines fonctionnalités d'iOS 15 pointent vers un avenir plus intelligent pour iPhone

- Articles Similaires:

Qu'est-ce que le Neural Engine sur iPhone ?

Le Neural Engine est un processeur sur iPhone X et versions ultérieures qui gère les opérations d'apprentissage automatique. C'est la capacité de ce processeur à alimenter l'apprentissage automatique qui le rend si important, donc comprendre l'apprentissage automatique est important pour comprendre ce processeur.

L'apprentissage automatique fait référence à un logiciel qui prend des décisions sur le code à exécuter indépendamment d'un programmeur.

En règle générale, le logiciel doit fonctionner avec des données très spécifiques et contrôlées. C'est pourquoi Siri comprendra votre intention avec une phrase mais ne la comprendra pas avec une autre, même si l'intention de chaque phrase est identique. Siri a besoin que les données entrent dans une structure spécifique, ou cela échoue.

L'apprentissage automatique est un moyen de changer cela. Il permet au logiciel de prendre en charge des données moins structurées et de les traiter tout de même. Si jamais vous êtes surpris que Siri ait compris une demande étrangement formulée, c'est probablement parce que les capacités d'apprentissage automatique de Siri se sont améliorées.

Le Neural Engine est, comme son nom l'indique, le moteur de votre téléphone qui rend cela possible.

Je me rends compte que ces concepts peuvent être un peu difficiles à comprendre, et je sais que je ne fais peut-être pas le meilleur travail pour les expliquer. J'essaie de garder les choses courtes et simples pour ce post, mais si vous voulez une plongée plus profonde, vous devriez vérifier ce post!

Comment les fonctionnalités d'iOS 15 commencent à tirer parti du moteur neuronal

Le problème avec le moteur neuronal de l'iPhone n'est pas qu'il n'est pas puissant, mais que sa puissance n'est pas pleinement utilisée sur l'iPhone. Au cours des quatre dernières années, il a été mis en œuvre dans des cas limités, comme la réalité augmentée. C'est utile, mais cela n'a pas encore révolutionné l'iPhone.

Je pense que plusieurs fonctionnalités d'iOS 15 laissent présager un avenir plus révolutionnaire pour le moteur neuronal. Je ne pense pas qu'aucune des nouvelles fonctionnalités que je suis sur le point de présenter ci-dessous ne serait possible sans ce processeur. Voyons donc comment ces fonctionnalités utilisent au maximum le moteur neuronal.

Votre iPhone peut lire le texte de vos photos

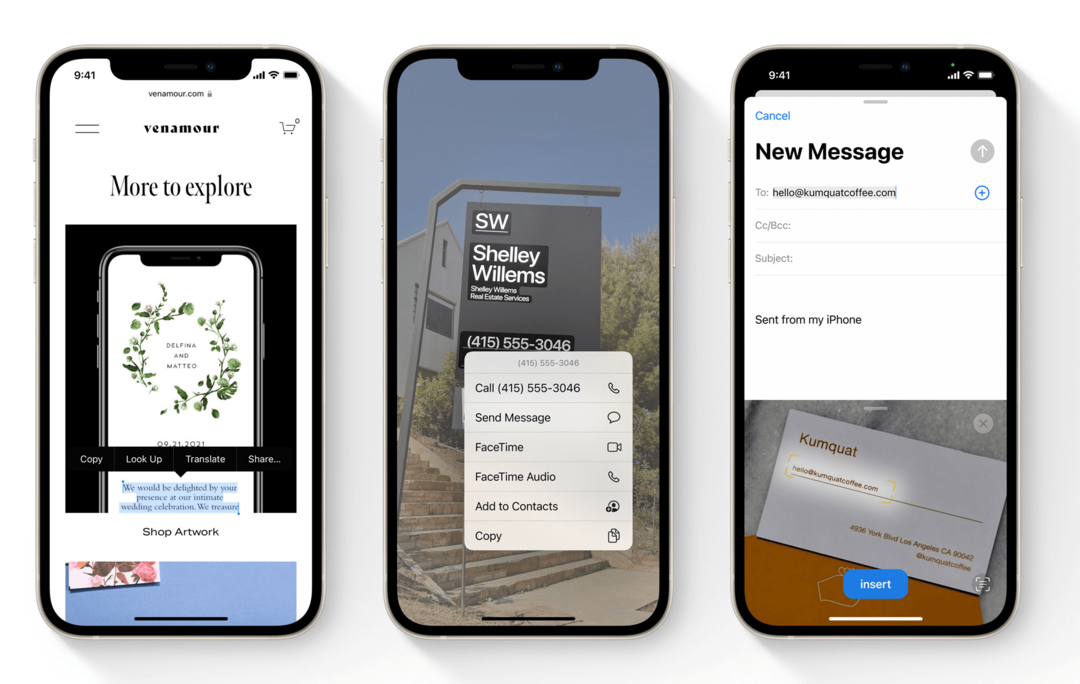

La première des fonctionnalités d'iOS 15 qui criait « Apprentissage automatique! » pour moi, c'était Live Text. Live Text est une fonctionnalité d'iOS 15 qui permet à votre iPhone de lire du texte dans votre application Photos.

Cela signifie que vous pouvez prendre une photo de tout ce qui contient du texte imprimé, ouvrir cette photo dans l'application Photos et vous pourrez interagir avec ce texte. Vous pouvez appuyer sur les numéros de téléphone dans les photos, copier et coller du texte à partir d'images de documents et utiliser la barre de recherche dans Photos pour rechercher du texte dans les photos.

Cette fonctionnalité permet également à votre iPhone de lire l'écriture manuscrite sur vos photos. Il fonctionne également avec l'application Appareil photo, vous pouvez donc interagir avec le texte dans le viseur de l'appareil photo de votre iPhone en temps réel.

Sans l'apprentissage automatique, une fonctionnalité comme celle-ci serait presque impossible. C'est pourquoi ces tests de sécurité en ligne utilisent du texte déformé pour prouver que vous n'êtes pas un robot. Parce qu'il est difficile pour un programme de pouvoir lire du texte.

Non seulement une fonction de smartphone qui peut lire du texte quelle que soit la police, le style, la couleur ou l'angle, en temps réel extrêmement utile, c'est aussi une excellente utilisation de l'apprentissage automatique mobile.

Les fonctionnalités d'iOS 15 permettront à votre iPhone de reconnaître et d'identifier le contenu de vos photos

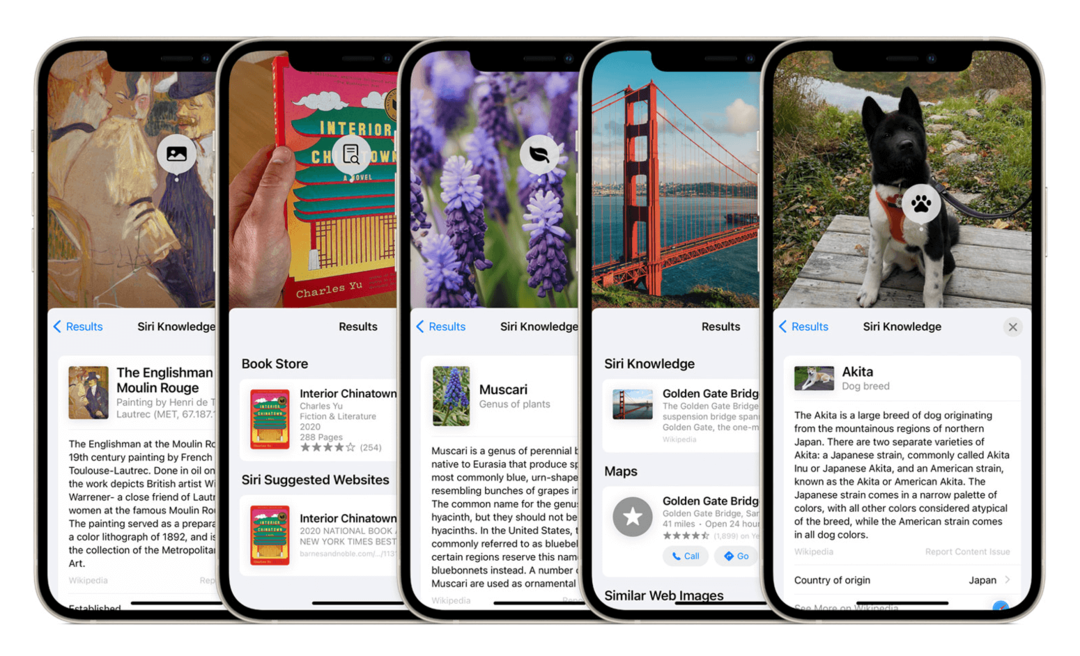

Une autre des nouvelles fonctionnalités d'iOS 15 qui utilise le Neural Engine est la reconnaissance d'objets dans Photos. Cette fonctionnalité fonctionne de la même manière que Live Text, sauf qu'elle reconnaît les objets plutôt que le texte. L'exemple utilisé par Apple est que vous pouvez pointer l'appareil photo de votre iPhone vers un chien, et votre iPhone reconnaîtra non seulement qu'il s'agit d'un chien, mais aussi de quelle race de chien il s'agit.

L'iPhone est capable d'extraire des visages de vos photos depuis un certain temps, ce qui est une forme de reconnaissance d'objets, bien que limitée. Cette extension de cette capacité permettra à votre iPhone d'examiner rapidement les données non structurées d'une photo et les objets d'identité qu'il contient.

C'est plus impressionnant (et difficile) que Live Text car les modèles que le Neural Engine doit rechercher seront beaucoup moins cohérents. Votre iPhone devra prendre des milliers (voire des centaines de milliers) de décisions pour pouvoir prendre de telles décisions.

Pour identifier une race de chien, il faudra d'abord voir qu'un chien est un objet distinct de l'arrière-plan, puis il devra tracer des limites autour de ce chien, puis choisir des caractéristiques distinctes de ce chien jusqu'à ce qu'il puisse déterminer qu'il s'agit d'un chien, puis extraire encore plus de caractéristiques pour déterminer quel type de chien il est.

Ce type de calcul n'est possible qu'avec un processeur d'apprentissage automatique.

Les souvenirs dans les photos vont être plus sophistiqués et plus "réels"

Les mémoires sont une autre fonctionnalité de l'application Photos qui bénéficiera d'une retouche Neural Engine.

Cette fonctionnalité prend des photos à une certaine heure (généralement un jour spécifique) et les combine dans une courte vidéo que vous pouvez visualiser. L'idée étant que Memories créera automatiquement des collages vidéo de vos vacances, fêtes, anniversaires et plus encore.

Les souvenirs sont une autre des fonctionnalités d'iOS 15 dont la qualité augmente considérablement. Il incorporera automatiquement la musique de votre bibliothèque Apple Music dans vos souvenirs.

La musique choisie par Photos sera non seulement rythmée de manière appropriée avec la vidéo, mais elle devra également correspondre au contenu de la vidéo. Par exemple, les images d'une fête doivent être associées à de la musique énergique, tandis que les photos plus réfléchies doivent être accompagnées d'une musique plus lente.

Bien que je n'utilise pas souvent cette fonctionnalité, l'informatique qui la sous-tend est extrêmement fascinante. Il combine la reconnaissance d'objets et de paysages, regroupe les photos en fonction du contenu, de l'emplacement et de la période, sépare les photos quotidiennes moyennes des photos liées à une vie spéciale événements, établit un lien entre l'ambiance de ces photos et l'ambiance d'une chanson que vous aimez, les associe dans une présentation en diaporama et chronomètre cette présentation au rythme de la musique.

Memories a toujours utilisé le Neural Engine. Et la prochaine version d'iOS devrait augmenter considérablement l'intelligence de cette fonctionnalité.

Les notifications, les widgets et le mode Ne pas déranger deviennent plus intelligents

Les notifications, les widgets et Ne pas déranger sont un regroupement de fonctionnalités iOS 15 qui tirent davantage parti du moteur neuronal.

Les widgets ont commencé à utiliser l'apprentissage automatique dans iOS 14, mais j'ai pensé qu'il serait utile de les ajouter ici. Les Smart Stacks vous permettent de superposer des widgets. Votre iPhone les parcourra ensuite tout au long de la journée, vous montrant ce qu'il pense être le widget le plus pertinent à un moment donné.

Ces types de décisions sont prises en analysant votre comportement à différents moments de la journée et après avoir utilisé certaines applications. Le moteur neuronal prend ces données, les interprète, puis affiche vos widgets en fonction de ces données.

Les nouvelles fonctionnalités d'iOS 15 sont configurées pour fonctionner de manière très similaire.

Les notifications seront désormais regroupées dans un résumé des notifications, de sorte que vous ne verrez pas de notifications moins importantes envahir votre écran de verrouillage toute la journée. Vous pouvez personnaliser la fonction de résumé des notifications ou laisser le moteur neuronal le gérer pour vous.

Ne pas déranger obtient un nouveau composant, Focus, qui masquera certaines notifications en fonction de la façon dont elles sont classées. Vous pouvez gérer Focus manuellement ou le laisser se gérer intelligemment.

Ces trois fonctionnalités vont utiliser des métriques d'apprentissage automatique extrêmement similaires pour prédire et s'adapter à votre comportement.

Les nouvelles fonctionnalités d'iOS 15 faciliteront l'obtention d'itinéraires avec votre appareil photo

C'est l'une des fonctionnalités d'iOS 15 dont je n'ai pas entendu parler autant que je m'y attendais. Je trouve toujours que c'est très intéressant, surtout dans un contexte d'apprentissage automatique.

Dans Maps sous iOS 15, vous pourrez pointer votre appareil photo tout en marchant. Cela vous permettra de voir les directions AR projetées sur votre environnement. Supposons que vous essayez d'aller au cinéma et que vous ne savez pas quelle route prendre. Vous pourrez pointer votre iPhone et voir les directions mises en évidence dans les rues et les bâtiments autour de vous.

La réalité augmentée sur iPhone a été rendue possible grâce à l'inclusion du moteur neuronal, cette fonctionnalité doit donc ses origines à l'apprentissage automatique. Mais cette fonctionnalité combine également la RA avec la reconnaissance d'images et la détection de localisation pour offrir une expérience en temps réel incroyable.

Bien qu'elle ne soit disponible que dans quelques villes au lancement, cette fonctionnalité laisse présager un avenir où l'apprentissage automatique sur iPhone ne vous aide pas seulement en arrière-plan. Il pourra vous aider à réaliser instantanément des choses qui sont en dehors de votre zone de confort ou de vos capacités.

Siri effectuera plus de traitement sur votre appareil

La dernière des fonctionnalités d'iOS 15 qui tire le meilleur parti du moteur neuronal est Siri. Siri a toujours utilisé l'apprentissage automatique. Mais cet apprentissage n'a pas encore maximisé le potentiel du moteur neuronal.

C'est parce que Siri a utilisé le traitement hors appareil. Cela signifie que votre iPhone écoute votre demande, l'envoie à un serveur Apple qui traite la demande, puis la renvoie à Siri sur votre iPhone pour donner suite à cette demande.

La raison pour laquelle cela a été fait était d'augmenter la puissance de Siri au-delà de ce que l'iPhone pouvait prendre en charge. Dans iOS 15, cependant, cela devrait changer. Siri effectuera désormais la majorité de son traitement sur votre iPhone. Cela devrait rendre Siri plus rapide, plus intelligent et plus fiable.

Je pense que cette mise à jour nécessitera probablement le moins d'aide du moteur neuronal. D'où son placement en fin de liste. Cela vaut la peine de noter, cependant, car cela indique que Siri devient plus intelligent. Un assistant plus capable utilisant le matériel sur iPhone, pas un serveur lointain.

Que peut faire le Neural Engine sans les prochaines fonctionnalités d'iOS 15 ?

Et c'est tout! Pour autant que je sache, ce sont toutes les nouvelles façons dont les fonctionnalités d'iOS 15 vont commencer à utiliser la puissance brute du moteur neuronal.

Je voulais inclure une brève section à la fin de cet article mettant en évidence certaines des choses que le moteur neuronal fait déjà sur votre iPhone. De cette façon, vous pouvez comparer où il se trouve aujourd'hui à ce qu'il sera dans quelques mois.

Espérons que cela vous aidera à apprécier les modifications à venir d'iOS sous un nouveau jour et à mieux comprendre comment de telles fonctionnalités arrivent sur votre iPhone.

Le moteur neuronal vous aide à prendre de meilleures photos

Je dirais que la plus grande utilisation du Neural Engine sur iPhone depuis 2017 a été en photographie. Chaque année, Apple montre comment le dernier iPhone sera capable d'effectuer plus de calculs photographiques que la génération précédente. Apple dit des choses comme: « Le processeur d'image effectue X millions de calculs/décisions par photo ».

Il s'agit du nombre de calculs effectués par le Neural Engine chaque fois que vous prenez une photo. Il examine les couleurs, l'éclairage, les éléments de contraste, le sujet, l'arrière-plan et une multitude d'autres facteurs. Et il détermine comment évaluer, ajuster, absorber et équilibrer au mieux tous ces éléments en un instant.

C'est ce processus d'apprentissage automatique qui a rendu possible des choses comme le mode portrait et la fusion profonde. Le mode Portrait peut vous isoler de votre arrière-plan, et Deep Fusion a rendu la photographie de nuit sur iPhone considérablement meilleure qu'auparavant.

Le Neural Engine est essentiel à l'appareil photo de votre iPhone en raison des contraintes matérielles. En raison de la taille de l'iPhone, la capacité de l'appareil photo et de ses objectifs est limitée. C'est l'informatique et l'apprentissage automatique qui se produisent lorsque vous prenez une photo qui rend la photographie de votre iPhone à égalité avec les photos d'un reflex numérique professionnel.

L'apprentissage automatique rend FaceID rapide, sécurisé et adaptatif

Bien sûr, nous ne pouvons pas parler du Neural Engine sans mentionner pourquoi il a été créé.

C'est vrai - le Neural Engine a été ajouté à l'iPhone X pour rendre FaceID possible. Au cas où vous ne le sauriez pas, FaceID est l'une des fonctionnalités les plus sophistiquées et complexes de votre iPhone.

FaceID ne se contente pas de comparer l'image 2D de votre visage dans la caméra selfie à une autre image 2D de votre visage. Il examine une carte 3D de votre visage, suit le mouvement de vos yeux et le compare à un scan 3D précédent de votre visage.

FaceID ne se contente pas de le faire en moins de deux secondes lorsque votre visage est en mouvement, partiellement obscurci et sous différents angles. Il s'adapte également à la façon dont votre visage change subtilement de jour en jour. C'est pourquoi vous pouvez vous laisser pousser la barbe, vieillir et changer d'autres manières subtiles sans avoir à renumériser votre visage.

FaceID et le Neural Engine étudient et apprennent de votre visage chaque fois que vous déverrouillez votre iPhone. Sans le moteur neuronal, FaceID ne serait pas aussi rapide, sécurisé ou fiable qu'aujourd'hui.

Le Neural Engine joue un rôle clé dans les expériences AR sur iPhone

Enfin, le Neural Engine joue un rôle clé dans la réalité augmentée sur iPhone. Pour ceux qui ne le savent pas, la réalité augmentée (AR) est une fonctionnalité qui projette des modèles 3D sur votre environnement via le viseur de l'appareil photo de votre iPhone. Vous pouvez tester cela par vous-même en utilisant l'application Mesure sur votre iPhone.

Ce type de fonctionnalité combine des éléments tels que la reconnaissance d'images, la conscience spatiale et la mémoire. Tout cela nécessite la puissance que le moteur neuronal apporte à la table.

Heureusement, bon nombre des nouvelles fonctionnalités d'iOS 15 sont conçues pour rendre la réalité augmentée sur iPhone encore plus puissante. J'espère que c'est une tendance qui se poursuivra, car je pense que la RA a le potentiel d'être l'une des fonctionnalités les plus intégrées des appareils mobiles.

Les prochaines fonctionnalités d'iOS 15 pointent vers un avenir plus intelligent pour iPhone

Dans l'ensemble, je suis très enthousiaste pour l'avenir que ces fonctionnalités d'iOS 15 nous donnent un aperçu. Il y a plusieurs facettes de l'iPhone qui semblent un peu sous-utilisées, mais peu autant que le Neural Engine. J'ai hâte que cela change, et j'espère que vous aussi !

Pour plus d'informations, d'informations et de conseils sur tout ce qui concerne Apple, consultez le reste de le blog AppleToolBox!