Nézés közben a WWDC21 vitaindítóját néhány hete kezdtem észrevenni egy visszatérő témát. És ez a téma az, hogy az iOS 15 számos közelgő funkciója kihasználja az iPhone neurális motorját.

A Neural Engine az iPhone X 2017-es megjelenése óta megtalálható az iPhone-ban. Azt hiszem azonban, hogy a legtöbben egyáltalán nem éreztük ennek a processzornak a hatását az első megjelenés óta eltelt négy év során.

A WWDC21 folyamatosan azt az érzést keltette bennem, hogy az iOS 15 hosszú idő óta az első futurisztikus iOS-frissítés. És bár erre nincs hivatalos megerősítés az Apple-től, úgy gondolom, hogy ez azért van, mert az Apple végre teljes mértékben kihasználja a neurális motor előnyeit.

Ebben a bejegyzésben röviden kitérek arra, hogy mi is az a Neural Engine, majd belemerülök az iOS 15 összes új funkciójába, amelyek a jelek szerint teljes mértékben kihasználják ezt a processzort. A végéhez közeledve bemutatom azokat a főbb módokat, amelyekkel az iOS jelenleg használja a Neural Engine-t, hogy összehasonlíthassa azt a közelgő iOS 15 kiadással.

Rendben, vágjunk bele!

Tartalom

- Mi az a Neural Engine az iPhone-on?

-

Hogyan kezdik kihasználni az iOS 15 funkciói a neurális motor előnyeit

- Az iPhone készüléke képes szöveget olvasni a fényképeken

- Az iOS 15 funkciói lehetővé teszik iPhone-ja számára, hogy felismerje és azonosítsa a fotók tartalmát

- Az emlékek a Fotókban kifinomultabbak és „igazibb” érzések lesznek

- Az értesítések, a modulok és a Ne zavarjanak mód egyre okosabbak

- Az iOS 15 új funkciói megkönnyítik az útvonaltervezést a kamerával

- A Siri több feldolgozást végez az eszközön

-

Mire képes a Neural Engine az iOS 15 közelgő funkciói nélkül?

- A Neural Engine segítségével jobb képeket készíthet

- A gépi tanulás gyorssá, biztonságossá és alkalmazkodóvá teszi a FaceID-t

- A Neural Engine kulcsszerepet játszik az AR-élményekben iPhone-on

-

Az iOS 15 közelgő funkciói az iPhone intelligensebb jövője felé mutatnak

- Kapcsolódó hozzászólások:

Mi az a Neural Engine az iPhone-on?

A Neural Engine egy processzor az iPhone X és újabb készülékeken, amely gépi tanulási műveleteket kezel. Ennek a processzornak a gépi tanulásra való képessége teszi annyira fontossá, ezért a gépi tanulás megértése fontos a processzor megértéséhez.

A gépi tanulás olyan szoftverekre vonatkozik, amelyek a programozótól függetlenül döntenek arról, hogy milyen kódot hajtsanak végre.

A szoftvernek általában nagyon specifikus és ellenőrzött adatokkal kell működnie. Ezért a Siri megérti az Ön szándékát az egyik kifejezéssel, de nem érti meg a másikkal – még akkor sem, ha a szándék az egyes kifejezésekben azonos. A Sirinek egy meghatározott struktúrában kell lennie az adatoknak, különben meghiúsul.

A gépi tanulás egy módja ennek megváltoztatására. Lehetővé teszi, hogy a szoftver kevésbé strukturált adatokat fogadjon be, és továbbra is feldolgozza azokat. Ha valaha is meglepődött azon, hogy Siri megértette a furcsán megfogalmazott kérést, annak valószínűleg az az oka, hogy a Siri gépi tanulási képességei javultak.

A Neural Engine, ahogy a neve is sugallja, a telefon motorja, amely ezt lehetővé teszi.

Tisztában vagyok vele, hogy ezeket a fogalmakat kissé nehéz megérteni, és tudom, hogy nem biztos, hogy a legjobban magyarázom el őket. Igyekszem röviden és egyszerűen fogalmazni ebben a bejegyzésben, de ha mélyebbre szeretnél merülni, nézd meg ez a poszt!

Hogyan kezdik kihasználni az iOS 15 funkciói a neurális motor előnyeit

Az iPhone neurális motorjával nem az a probléma, hogy nem erős, hanem az, hogy az iPhone nem használja ki teljes mértékben az erejét. Az elmúlt négy évben korlátozott esetekben, például a kiterjesztett valóságban működött. Hasznos, de még nem forradalmasította az iPhone-t.

Úgy gondolom, hogy az iOS 15 számos funkciója a Neural Engine forradalmibb jövője felé mutat. Nem hiszem, hogy az alábbiakban lebontandó új funkciók egyike sem lehetséges e processzor nélkül. Lássuk tehát, hogy ezek a funkciók hogyan használják ki a legteljesebb mértékben a neurális motort.

Az iPhone készüléke képes szöveget olvasni a fényképeken

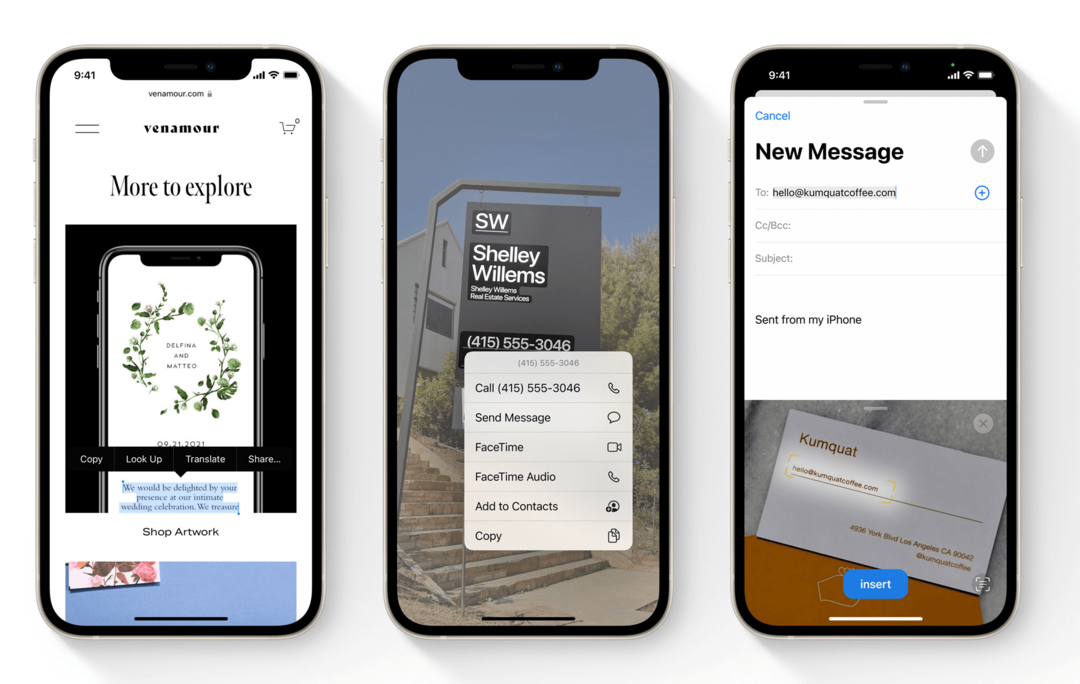

Az iOS 15 első olyan funkciója, amely „gépi tanulást” üvöltött! nekem az Élő szöveg volt. Az élő szöveg az iOS 15 olyan funkciója, amely lehetővé teszi az iPhone számára, hogy szöveget olvasson a Fotók alkalmazásban.

Ez azt jelenti, hogy bármit lefényképezhet nyomtatott szöveggel, megnyithatja azt a fotót a Fotók alkalmazásban, és interakcióba léphet a szöveggel. Megérintheti a telefonszámokat a fényképeken, szöveget másolhat és illeszthet be a dokumentumok képeiből, és a Fotók keresősávjával kereshet szöveget a fényképeken.

Ez a funkció azt is lehetővé teszi, hogy az iPhone beolvassa a kézírást a fényképeken. Működik a Kamera alkalmazással is, így valós időben kommunikálhat az iPhone fényképezőgépe keresőjében található szövegekkel.

Gépi tanulás nélkül egy ilyen funkció szinte lehetetlen lenne. Ez az oka annak, hogy ezek az online biztonsági tesztek torz szöveget használnak annak bizonyítására, hogy Ön nem robot. Mert kihívást jelent egy program számára, hogy képes legyen szöveget olvasni.

Nemcsak egy okostelefon-funkció, amely betűtípustól, stílustól, színtől vagy szögtől függetlenül képes szöveget olvasni, valós időben rendkívül hasznos, hanem a mobil gépi tanulás kiváló felhasználási módja is.

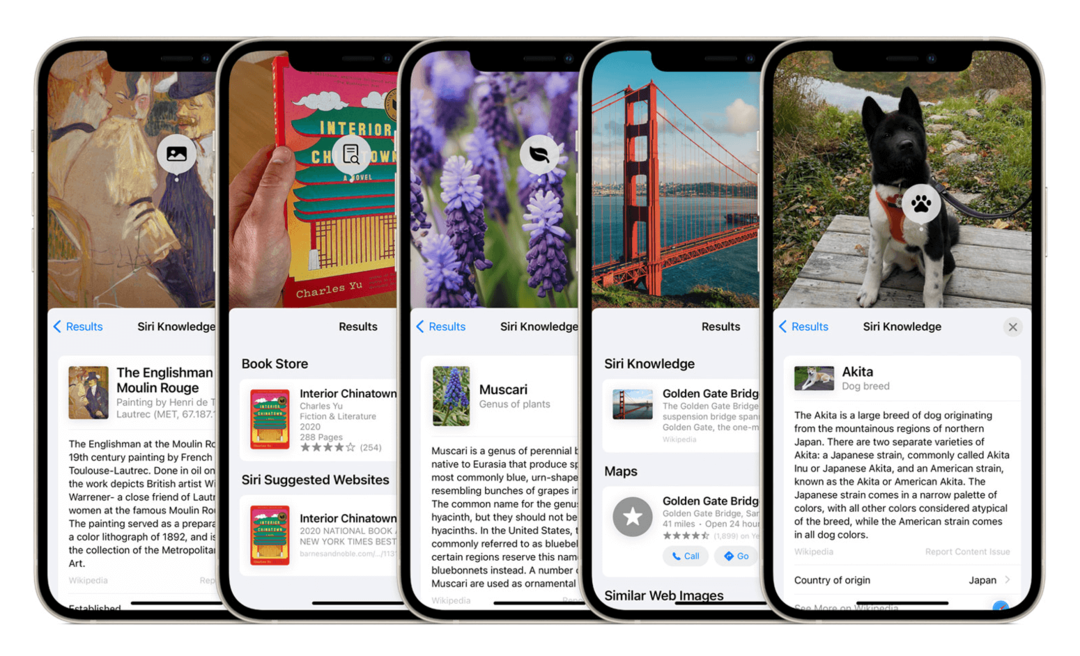

Az iOS 15 funkciói lehetővé teszik iPhone-ja számára, hogy felismerje és azonosítsa a fotók tartalmát

Egy másik új iOS 15 funkció, amely a Neural Engine-t használja, az objektumfelismerés a Fotókban. Ez a funkció az élő szöveghez hasonlóan működik, azzal a különbséggel, hogy szöveg helyett objektumokat ismer fel. Az Apple által használt példa az, hogy iPhone kameráját egy kutyára irányíthatja, és az iPhone nemcsak azt fogja felismerni, hogy az egy kutya, hanem azt is, hogy melyik kutyafajta.

Az iPhone egy ideje képes kihúzni az arcokat a fotóidból, ami az objektumfelismerés egyik formája, bár korlátozott. Ennek a képességnek a kibővítése lehetővé teszi, hogy iPhone-ja gyorsan megtekinthesse a fényképek strukturálatlan adatait és a benne lévő identitásobjektumokat.

Ez lenyűgözőbb (és nehezebb), mint az élő szöveg, mivel a minták, amelyeket a neurális motornak kell keresnie, sokkal kevésbé lesznek következetesek. Az iPhone készülékének több ezer (ha nem több százezer) döntést kell meghoznia ahhoz, hogy ilyen döntéseket tudjon hozni.

A kutyafajta azonosításához először látnia kell, hogy a kutya a háttértől eltérő tárgy, majd meg kell húznia a határokat a kutya körül, majd válassza ki a kutya különböző jellemzőit, amíg meg nem tudja állapítani, hogy kutyáról van szó, majd húzzon ki még több jellemzőt, hogy meghatározza, melyik kutyáról van szó. van.

Ez a fajta számítás csak gépi tanulási processzorral lehetséges.

Az emlékek a Fotókban kifinomultabbak és „igazibb” érzések lesznek

A Photos alkalmazás egy másik funkciója, amely a Neural Engine javítást kapja, a Memories.

Ez a funkció egy bizonyos időpontról (általában egy adott napról) készít fényképeket, és ezeket egy rövid videóban egyesíti, hogy megtekinthesse. Az ötlet az, hogy a Memories automatikusan videokollázsokat készít nyaralásairól, bulikról, évfordulóiról stb.

Az emlékek az iOS 15 egyik olyan funkciója, amely jelentősen javítja a minőséget. Automatikusan beépíti az Apple Music könyvtárból származó zenét az Emlékei közé.

A Photos által kiválasztott zene nem csak a videóhoz igazodik, hanem meg kell egyeznie a videó tartalmával is. Például egy parti képeit energikus zenével kell párosítani, míg az átgondoltabb fényképekhez lassabb zenét kell csatolni.

Bár nem használom gyakran ezt a funkciót, a mögötte álló számítástechnika rendkívül lenyűgöző. Egyesíti a tárgy- és tájfelismerést, csoportosítja a fényképeket tartalom, hely és időszak alapján, elválasztja az átlagos napi képeket a különleges élethez kötődő fényképektől. eseményeket, kapcsolatot teremt a fotók hangulata és egy Önnek tetsző dal hangulata között, párosítja őket diavetítésben, és a bemutatót a zene.

A Memories mindig is a neurális motort használta. Az iOS következő verziója pedig jelentősen növeli ennek a funkciónak az intelligenciáját.

Az értesítések, a modulok és a Ne zavarjanak mód egyre okosabbak

Az iOS 15 funkcióinak egy csoportja, amelyek jobban kihasználják a Neural Engine előnyeit, az értesítések, a widgetek és a Ne zavarjanak.

A widgetek az iOS 14-ben kezdték el használni a gépi tanulást, de úgy gondoltam, hasznos lenne felvenni őket ide. Az intelligens kötegek lehetővé teszik a kütyü egymásra helyezését. Az iPhone ezután a nap folyamán végiglapozza őket, és megmutatja, hogy szerinte az adott időpontban melyik a legrelevánsabb widget.

Az ilyen típusú döntéseket a nap különböző szakaszaiban és bizonyos alkalmazások használata utáni viselkedésének elemzésével hozzák meg. A Neural Engine veszi ezeket az adatokat, értelmezi, majd ezeknek az adatoknak megfelelően megjeleníti a widgeteket.

Az iOS 15 új funkciói nagyon hasonlóan működnek.

Az értesítések mostantól az Értesítések összefoglalójában lesznek csoportosítva, így nem látja, hogy kevésbé fontos értesítések zsúfolják el egész nap a Lezárási képernyőt. Testreszabhatja az Értesítési összefoglaló funkciót, vagy hagyhatja, hogy a Neural Engine kezelje azt Ön helyett.

A Ne zavarjanak új komponenst, a Focust kap, amely elrejti bizonyos értesítéseket a kategorizálásuk alapján. A Focust manuálisan is kezelheti, vagy hagyhatja, hogy intelligensen kezelje magát.

Mindhárom funkció rendkívül hasonló gépi tanulási mérőszámokat fog használni az Ön viselkedésének előrejelzéséhez és az ahhoz való alkalmazkodáshoz.

Az iOS 15 új funkciói megkönnyítik az útvonaltervezést a kamerával

Ez az iOS 15 egyik funkciója, amelyről nem hallottam akkora izgalmat, mint amire számítottam. Még mindig nagyon érdekesnek találom, különösen gépi tanulási környezetben.

Az iOS 15 rendszerben futó Térkép alkalmazásban járás közben is körbe tudja irányítani a kamerát. Ez lehetővé teszi, hogy az AR-irányokat a környezetére vetítve tekintse meg. Tegyük fel, hogy moziba próbál menni, és nem tudja, melyik utat válassza. Körbe irányíthatja iPhone-ját, és megtekintheti az útbaigazítást a környező utcákon és épületeken.

Az iPhone kiterjesztett valóságát a Neural Engine beépítése tette lehetővé, így ez a funkció a gépi tanulásnak köszönhető. De ez a funkció az AR-t képfelismeréssel és helyérzékeléssel is kombinálja, hogy hihetetlen valós idejű élményt nyújtson.

Bár a bevezetéskor csak néhány városban lesz elérhető, ez a funkció egy olyan jövő felé mutat, ahol az iPhone gépi tanulása nem csak a háttérben segít. Segíthet azonnal elérni azokat a dolgokat, amelyek kívül esnek komfortzónádon vagy képességein.

A Siri több feldolgozást végez az eszközön

Az iOS 15 utolsó funkciója, amely jobban kihasználja a Neural Engine előnyeit, a Siri. A Siri mindig is gépi tanulást használt. De ez a tanulás még nem használta ki a neurális motorban rejlő lehetőségeket.

Ennek az az oka, hogy a Siri az eszközön kívüli feldolgozást használta. Ez azt jelenti, hogy iPhone-ja meghallgatja kérését, elküldi azt egy Apple-szervernek, amely feldolgozza a kérést, majd visszaküldi az iPhone-ján lévő Siri-nek, hogy eljárja a kérésnek megfelelően.

Ennek oka az volt, hogy a Siri teljesítményét az iPhone által támogatni képes fölé növelték. Az iOS 15-ben azonban ez megváltozik. A Siri mostantól a feldolgozás nagy részét iPhone-ján végzi el. Ettől a Siri gyorsabb, intelligensebb és megbízhatóbb lesz.

Úgy gondolom, hogy ez a frissítés valószínűleg a legkevesebb segítséget igényel a Neural Engine-től. Ezért került a lista végére. Érdemes azonban megjegyezni, mivel ez arra utal, hogy Siri egyre okosabb lesz. Képesebb asszisztens, aki az iPhone hardverét használja, nem egy távoli szerveren.

Mire képes a Neural Engine az iOS 15 közelgő funkciói nélkül?

És ez az! Amennyire meg tudom mondani, ez mind az új módok közül, amellyel az iOS 15 funkciói elkezdik használni a Neural Engine nyers erejét.

A bejegyzés végére egy rövid szakaszt szerettem volna beilleszteni, amely kiemeli azokat a dolgokat, amelyeket a Neural Engine már megtesz az iPhone-on. Így összehasonlíthatja a jelenlegi helyzetét azzal, hogy hol lesz néhány hónap múlva.

Remélhetőleg ez segít abban, hogy új megvilágításban értékelje az iOS közelgő változásait, és jobban megértse, hogyan érkeznek iPhone-jához az ehhez hasonló funkciók.

A Neural Engine segítségével jobb képeket készíthet

Azt mondanám, hogy 2017 óta az iPhone-on a Neural Engine-t a fotózásban használják a legnagyobb mértékben. Az Apple minden évben bemutatja, hogy a legújabb iPhone hogyan lesz képes több fényképezési számítást elvégezni, mint az előző generáció. Az Apple azt mondja, hogy „A képfeldolgozó X millió számítást/döntést hoz fotónként”.

Ez a Neural Engine által végzett számítások számára vonatkozik, amikor Ön fényképet készít. Figyeli a színeket, a világítást, a kontrasztos elemeket, a témát, a hátteret és sok más tényezőt. És ez határozza meg, hogyan lehet a legjobban értékelni, beállítani, felszívni és kiegyensúlyozni ezeket az elemeket egy pillanat alatt.

Ez a gépi tanulási folyamat tette lehetővé az olyan dolgokat, mint a Portré mód és a Deep Fusion. A Portré mód el tudja különíteni Önt a háttértől, a Deep Fusion pedig lényegesen jobbá tette az éjszakai fényképezést iPhone-on, mint korábban.

A neurális motor kritikus fontosságú az iPhone kamerája számára a hardveres korlátok miatt. Az iPhone mérete miatt a kamera és lencséi korlátozottak. Ez a számítástechnika és a gépi tanulás történik, amikor fényképet készít, és így iPhone-ja egyenrangúvá válik a professzionális DSLR-ről készült fényképekkel.

A gépi tanulás gyorssá, biztonságossá és alkalmazkodóvá teszi a FaceID-t

Természetesen nem beszélhetünk a neurális motorról anélkül, hogy ne említenénk meg, miért hozták létre.

Így van – a Neural Engine-t hozzáadták az iPhone X-hez, hogy lehetővé tegye a FaceID-t. Ha nem tudná, a FaceID az iPhone egyik legkifinomultabb és legösszetettebb funkciója.

A FaceID nem csak a szelfikamerában lévő arc 2D-s képét hasonlítja össze egy másik 2D-s arcképével. Megnézi az arc 3D-s térképét, követi a szem mozgását, és összehasonlítja az arc korábbi 3D-s szkennelésével.

A FaceID ezt nem csak két másodpercnél rövidebb idő alatt teszi meg, miközben az arca mozgásban van, részben eltakarva és különböző szögekben. Alkalmazkodik ahhoz is, ahogy az arcod finoman változik napról napra. Ez az oka annak, hogy szakállat növeszthet, megöregedhet, és más finom módokon változhat anélkül, hogy újra le kellene vizsgálnia az arcát.

A FaceID és a Neural Engine minden alkalommal, amikor feloldja iPhone-ját, az Ön arcából tanul és tanul. A Neural Engine nélkül a FaceID feleannyira gyors, biztonságos és megbízható, mint manapság.

A Neural Engine kulcsszerepet játszik az AR-élményekben iPhone-on

Végül a Neural Engine kulcsszerepet játszik az iPhone-on futó AR-ben. Azok számára, akik nem ismerik, a kiterjesztett valóság (AR) egy olyan funkció, amely 3D modelleket vetít a környezetére az iPhone kamerája keresőjén keresztül. Kipróbálhatja ezt saját kezűleg az iPhone Measure alkalmazásával.

Ez a fajta funkció olyan dolgokat kombinál, mint a képfelismerés, a tértudatosság és a memória. Mindehhez az a teljesítmény szükséges, amelyet a neurális motor hoz az asztalra.

Szerencsére az iOS 15 új funkciói közül sok úgy van beállítva, hogy még erősebbé tegye az AR-t az iPhone-on. Remélhetőleg ez a tendencia folytatódik, mivel úgy gondolom, hogy az AR a mobileszközök egyik legintegráltabb funkciója lehet.

Az iOS 15 közelgő funkciói az iPhone intelligensebb jövője felé mutatnak

Összességében nagyon izgatott vagyok a jövőt illetően, amelyekbe az iOS 15 funkciói bepillantást engednek. Az iPhone-nak számos olyan oldala van, amely kissé kihasználatlannak tűnik, de kevés annyira, mint a neurális motor. Várom ezt a változást, és remélem, te is!

Az Apple-lel kapcsolatos további hírekért, betekintésekért és tippekért tekintse meg a többi részt az AppleToolBox blog!