mentre guardi il keynote della WWDC21 qualche settimana fa, ho iniziato a notare un tema ricorrente. E quel tema è che molte delle imminenti funzionalità di iOS 15 sembrano sfruttare il motore neurale dell'iPhone.

Il Neural Engine è presente su iPhone sin dal rilascio di iPhone X nel 2017. Tuttavia, non credo che la maggior parte di noi abbia sentito gli effetti di questo processore nei quattro anni trascorsi dal suo rilascio iniziale.

WWDC21 continuava a darmi la sensazione che iOS 15 sia il primo aggiornamento iOS futuristico da molto tempo. E, sebbene non ci sia una conferma ufficiale da parte di Apple su questo, credo che sia perché Apple sta finalmente sfruttando appieno il Neural Engine.

In questo post, tratterò brevemente di cosa sia il Neural Engine, quindi mi immergerò in tutte le nuove funzionalità di iOS 15 che sembrano utilizzare questo processore al massimo delle sue potenzialità. Verso la fine, tratterò i principali modi in cui iOS utilizza attualmente il motore neurale, in modo che tu possa confrontarlo con la prossima versione di iOS 15.

Va bene, entriamo nel merito!

Contenuti

- Che cos'è il motore neurale su iPhone?

-

Come le funzionalità di iOS 15 stanno iniziando a sfruttare il motore neurale

- Il tuo iPhone può leggere il testo nelle tue foto

- Le funzionalità di iOS 15 consentiranno al tuo iPhone di riconoscere e identificare i contenuti nelle tue foto

- I ricordi nelle foto saranno più sofisticati e "reali"

- Notifiche, widget e Non disturbare stanno diventando più intelligenti

- Le nuove funzionalità di iOS 15 renderanno più facile ottenere indicazioni stradali con la fotocamera

- Siri effettuerà più elaborazioni sul tuo dispositivo

-

Cosa può fare il Neural Engine senza le imminenti funzionalità di iOS 15?

- Il motore neurale ti aiuta a scattare foto migliori

- L'apprendimento automatico rende FaceID veloce, sicuro e adattivo

- Il Neural Engine gioca un ruolo chiave nelle esperienze AR su iPhone

-

Le imminenti funzionalità di iOS 15 puntano verso un futuro più intelligente per iPhone

- Post correlati:

Che cos'è il motore neurale su iPhone?

Il Neural Engine è un processore su iPhone X e versioni successive che gestisce le operazioni di apprendimento automatico. È la capacità di questo processore di potenziare l'apprendimento automatico che lo rende così importante, quindi comprendere l'apprendimento automatico è importante per comprendere questo processore.

L'apprendimento automatico si riferisce al software che prende decisioni su quale codice eseguire indipendentemente da un programmatore.

In genere, il software deve lavorare con dati molto specifici e controllati. Ecco perché Siri capirà il tuo intento con una frase ma non lo capirà con un'altra, anche se l'intento in ogni frase è identico. Siri ha bisogno che i dati arrivino in una struttura specifica, o fallisce.

L'apprendimento automatico è un modo per cambiarlo. Consente al software di acquisire dati meno strutturati e di elaborarli comunque. Se ti ritrovi mai sorpreso che Siri abbia capito una richiesta formulata in modo strano, è probabilmente perché le capacità di apprendimento automatico di Siri sono migliorate.

Il Neural Engine è, come suggerisce il nome, il motore del tuo telefono che lo rende possibile.

Mi rendo conto che questi concetti possono essere un po' difficili da capire e so che potrei non fare il miglior lavoro per spiegarli. Sto cercando di mantenere le cose brevi e semplici per questo post, ma se vuoi un'immersione più profonda, dovresti dare un'occhiata questo post!

Come le funzionalità di iOS 15 stanno iniziando a sfruttare il motore neurale

Il problema con il motore neurale dell'iPhone non è che non sia potente, ma che la sua potenza non viene utilizzata completamente su iPhone. Negli ultimi quattro anni, è stato utilizzato in casi limitati, come la realtà aumentata. È utile, ma non ha ancora rivoluzionato l'iPhone.

Penso che diverse funzionalità di iOS 15 indichino un futuro più rivoluzionario per il Neural Engine. Non credo che nessuna delle nuove funzionalità che sto per analizzare di seguito sarebbe possibile senza questo processore. Quindi vediamo come queste funzionalità utilizzano il Neural Engine al massimo.

Il tuo iPhone può leggere il testo nelle tue foto

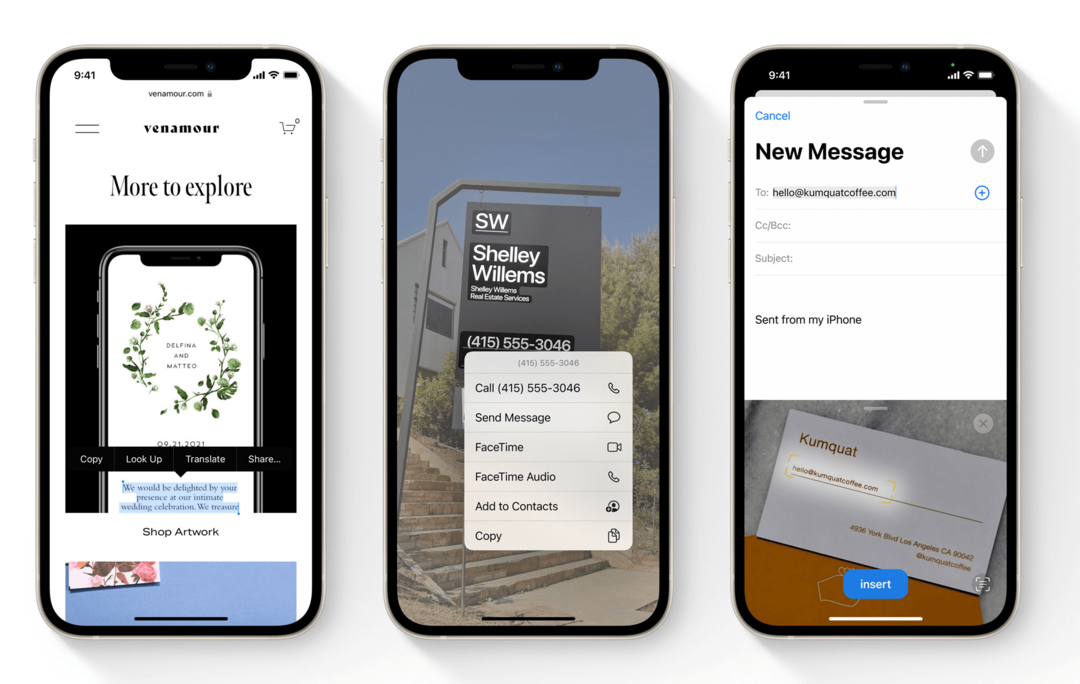

La prima delle funzionalità di iOS 15 che urlava "Apprendimento automatico!" per me era Live Text. Live Text è una funzionalità di iOS 15 che consente al tuo iPhone di leggere il testo nell'app Foto.

Ciò significa che puoi scattare una foto di qualsiasi cosa con testo stampato, aprire quella foto nell'app Foto e sarai in grado di interagire con quel testo. Puoi toccare i numeri di telefono nelle foto, copiare e incollare il testo dalle immagini dei documenti e utilizzare la barra di ricerca in Foto per cercare il testo nelle foto.

Questa funzione consente anche al tuo iPhone di leggere la scrittura a mano nelle tue foto. Funziona anche con l'app Fotocamera, quindi puoi interagire con il testo nel mirino della fotocamera del tuo iPhone in tempo reale.

Senza l'apprendimento automatico, una funzionalità come questa sarebbe quasi impossibile. Ecco perché quei test di sicurezza online utilizzano il testo deformato per dimostrare che non sei un robot. Perché è difficile per un programma essere in grado di leggere il testo.

Non solo una funzione per smartphone in grado di leggere il testo indipendentemente da carattere, stile, colore o angolazione, in tempo reale estremamente utile, è anche un ottimo uso dell'apprendimento automatico mobile.

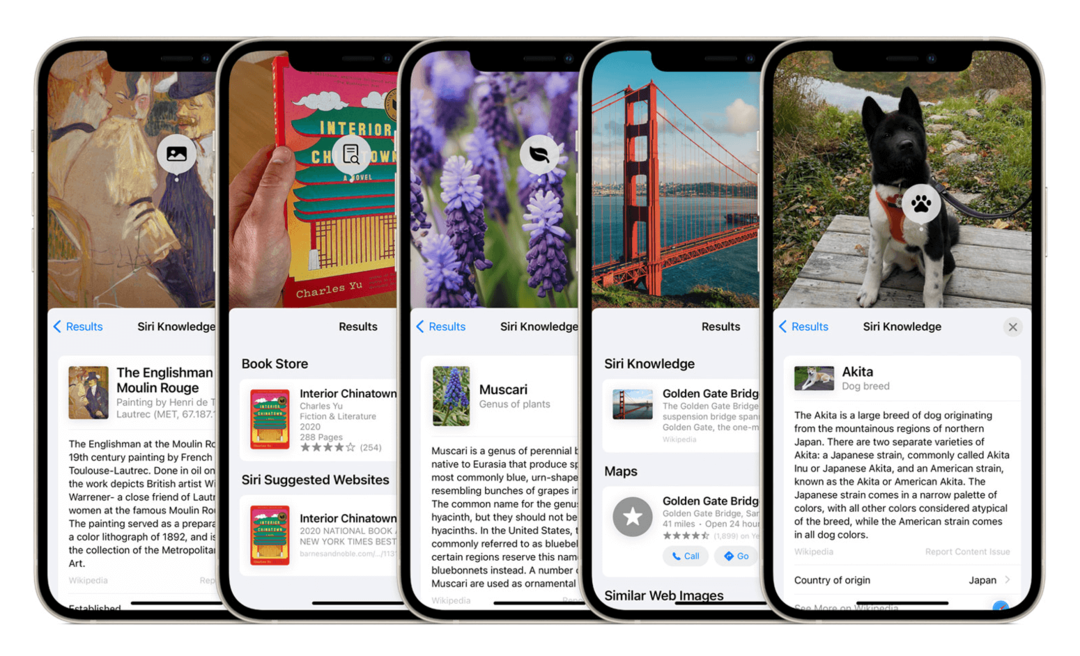

Le funzionalità di iOS 15 consentiranno al tuo iPhone di riconoscere e identificare i contenuti nelle tue foto

Un'altra delle nuove funzionalità di iOS 15 che utilizza il motore neurale è il riconoscimento degli oggetti in Foto. Questa funzione funziona in modo simile a Live Text, tranne per il fatto che riconosce gli oggetti anziché il testo. L'esempio utilizzato da Apple è che puoi puntare la fotocamera del tuo iPhone verso un cane e il tuo iPhone non solo riconoscerà che si tratta di un cane, ma anche di quale razza di cane è.

L'iPhone è stato in grado di estrarre i volti dalle tue foto per un po', che è una forma di riconoscimento degli oggetti, anche se limitata. Questa espansione di tale capacità consentirà al tuo iPhone di esaminare rapidamente i dati non strutturati di una foto e gli oggetti di identità al suo interno.

Questo è più impressionante (e difficile) di Live Text poiché i modelli che il Neural Engine deve cercare saranno molto meno coerenti. Il tuo iPhone dovrà prendere migliaia (se non centinaia di migliaia) di decisioni per poter prendere decisioni del genere.

Per identificare una razza di cane, dovrà prima vedere che un cane è un oggetto distinto dallo sfondo, quindi dovrà tracciare dei confini attorno a quel cane, quindi scegli caratteristiche distinte di quel cane fino a quando non può determinare che è un cane, quindi estrai ancora più caratteristiche per determinare che tipo di cane è è.

Questo tipo di elaborazione è possibile solo con un processore di apprendimento automatico.

I ricordi nelle foto saranno più sofisticati e "reali"

Un'altra caratteristica dell'app Foto che riceverà un ritocco del motore neurale è Ricordi.

Questa funzione scatta foto da una certa ora (di solito un giorno specifico) e le combina in un breve video da visualizzare. L'idea è che Ricordi creerà automaticamente collage video delle tue vacanze, feste, anniversari e altro.

I ricordi sono un'altra delle funzionalità di iOS 15 che ottengono un significativo aumento della qualità. Incorporerà automaticamente la musica dalla tua libreria di Apple Music nei tuoi ricordi.

La musica scelta da Foto non solo sarà sincronizzata in modo appropriato con il video, ma dovrebbe anche corrispondere al contenuto del video. Ad esempio, le immagini di una festa dovrebbero essere abbinate a musica energica, mentre le foto più ponderate dovrebbero avere una musica più lenta allegata.

Anche se non uso spesso questa funzione, l'informatica dietro di essa è estremamente affascinante. Combina il riconoscimento di oggetti e paesaggi, raggruppa le foto in base a contenuto, posizione e periodo di tempo, separa le foto quotidiane medie da quelle legate alla vita speciale eventi, disegna una connessione tra l'umore di quelle foto e l'umore di una canzone che ti piace, le abbina in una presentazione di diapositive e volte quella presentazione al ritmo del musica.

Memories ha sempre utilizzato il Neural Engine. E la prossima versione di iOS è destinata ad aumentare sostanzialmente l'intelligenza di questa funzione.

Notifiche, widget e Non disturbare stanno diventando più intelligenti

Un raggruppamento di funzionalità di iOS 15 che stanno sfruttando maggiormente il motore neurale sono notifiche, widget e Non disturbare.

I widget hanno iniziato a utilizzare l'apprendimento automatico in iOS 14, ma ho pensato che sarebbe stato utile aggiungerli qui. Smart Stacks ti consente di mettere i widget uno sopra l'altro. Il tuo iPhone li scorrerà quindi durante il giorno, mostrandoti quello che pensa sia il widget più rilevante in un dato momento.

Questo tipo di decisioni vengono prese analizzando il tuo comportamento in diversi momenti della giornata e dopo aver utilizzato determinate app. Il motore neurale prende questi dati, li interpreta e quindi visualizza i tuoi widget in base a questi dati.

Le nuove funzionalità di iOS 15 sono impostate per funzionare in modo molto simile.

Le notifiche verranno ora raggruppate in un riepilogo delle notifiche, quindi non vedrai notifiche meno importanti che affollano la schermata di blocco per tutto il giorno. Puoi personalizzare la funzione Riepilogo notifiche o lasciare che il motore neurale lo gestisca per te.

Non disturbare sta ottenendo un nuovo componente, Focus, che nasconderà determinate notifiche in base a come sono classificate. Puoi gestire Focus manualmente o lasciare che si gestisca da solo in modo intelligente.

Tutte e tre queste funzionalità utilizzeranno metriche di apprendimento automatico estremamente simili per prevedere e adattarsi al tuo comportamento.

Le nuove funzionalità di iOS 15 renderanno più facile ottenere indicazioni stradali con la fotocamera

Questa è una delle funzionalità di iOS 15 di cui non ho sentito così tanto entusiasmo come mi aspettavo. Lo trovo ancora molto interessante, soprattutto in un contesto di apprendimento automatico.

In Mappe in iOS 15, sarai in grado di puntare la fotocamera mentre cammini. Ciò ti consentirà di vedere le direzioni AR proiettate sul tuo ambiente. Diciamo che stai cercando di andare al cinema e non sei sicuro di quale strada prendere. Sarai in grado di puntare il tuo iPhone in giro e vedere le indicazioni stradali evidenziate nelle strade e negli edifici intorno a te.

La Realtà Aumentata su iPhone è stata resa possibile dall'inclusione del Neural Engine, quindi questa funzionalità deve le sue origini all'apprendimento automatico. Ma questa funzione combina anche l'AR con il riconoscimento delle immagini e il rilevamento della posizione per fornire un'incredibile esperienza in tempo reale.

Sebbene sarà disponibile solo in alcune città al momento del lancio, questa funzione punta a un futuro in cui l'apprendimento automatico su iPhone non ti aiuta solo in background. Sarà in grado di aiutarti a raggiungere istantaneamente cose che sono al di fuori della tua zona di comfort o abilità.

Siri effettuerà più elaborazioni sul tuo dispositivo

L'ultima delle funzionalità di iOS 15 che sfrutta maggiormente il Neural Engine è Siri. Siri ha sempre utilizzato l'apprendimento automatico. Ma quell'apprendimento non ha ancora sfruttato al massimo il potenziale del Neural Engine.

Questo perché Siri ha utilizzato l'elaborazione fuori dispositivo. Ciò significa che il tuo iPhone ascolta la tua richiesta, la invia a un server Apple che elabora la richiesta, quindi la rimanda a Siri sul tuo iPhone per agire su tale richiesta.

Il motivo per cui ciò è stato fatto è stato quello di aumentare la potenza di Siri oltre ciò che l'iPhone potrebbe supportare. In iOS 15, tuttavia, questo è destinato a cambiare. Siri ora eseguirà la maggior parte dell'elaborazione sul tuo iPhone. Ciò dovrebbe rendere Siri più veloce, più intelligente e più affidabile.

Penso che questo aggiornamento richiederà probabilmente la minima assistenza da parte del Neural Engine. Da qui la sua collocazione alla fine dell'elenco. Vale la pena notare, tuttavia, poiché indica che Siri diventa più intelligente. Un assistente più capace che utilizza l'hardware su iPhone, non un server lontano.

Cosa può fare il Neural Engine senza le imminenti funzionalità di iOS 15?

E questo è tutto! Per quanto ne so, sono tutti i nuovi modi in cui le funzionalità di iOS 15 inizieranno a utilizzare la potenza pura del Neural Engine.

Volevo includere una breve sezione alla fine di questo post che mettesse in evidenza alcune delle cose che il Neural Engine fa già sul tuo iPhone. In questo modo, puoi confrontare dov'è oggi e dove sarà tra qualche mese.

Si spera che questo ti aiuti ad apprezzare le imminenti modifiche a iOS sotto una nuova luce e a capire meglio come funzioni come questa arrivano sul tuo iPhone.

Il motore neurale ti aiuta a scattare foto migliori

Direi che il più grande utilizzo del Neural Engine su iPhone dal 2017 è stato nella fotografia. Ogni anno, Apple mostra come il nuovo iPhone sarà in grado di eseguire più calcoli fotografici rispetto alla generazione precedente. Apple dice cose come "Il processore di immagini sta facendo X milioni di calcoli/decisioni per foto".

Questo si riferisce al numero di calcoli che il motore neurale fa ogni volta che scatti una foto. Esamina i colori, l'illuminazione, gli elementi di contrasto, il soggetto, lo sfondo e una moltitudine di altri fattori. E determina come valutare, regolare, assorbire e bilanciare al meglio tutti questi elementi in un istante.

È questo processo di apprendimento automatico che ha reso possibili cose come la modalità Ritratto e Deep Fusion. La modalità Ritratto può isolarti dallo sfondo e Deep Fusion ha reso la fotografia notturna su iPhone sostanzialmente migliore di prima.

Il Neural Engine è fondamentale per la fotocamera del tuo iPhone a causa dei vincoli hardware. A causa delle dimensioni dell'iPhone, la capacità della fotocamera e dei suoi obiettivi è limitata. Sono l'elaborazione e l'apprendimento automatico che si verificano quando scatti una foto che rende la fotografia del tuo iPhone alla pari con le foto di una reflex digitale professionale.

L'apprendimento automatico rende FaceID veloce, sicuro e adattivo

Ovviamente, non possiamo parlare del Neural Engine senza menzionare il motivo per cui è stato creato.

Esatto: il Neural Engine è stato aggiunto all'iPhone X per rendere possibile FaceID. Nel caso non lo sapessi, FaceID è una delle funzionalità più sofisticate e complesse del tuo iPhone.

FaceID non confronta solo l'immagine 2D del tuo viso nella selfie cam con un'altra immagine 2D del tuo viso. Guarda una mappa 3D del tuo viso, tiene traccia del movimento degli occhi e lo confronta con una precedente scansione 3D del tuo viso.

FaceID non si limita a farlo in meno di due secondi mentre il tuo viso è in movimento, parzialmente oscurato e con angolazioni variabili. Si adatta anche al modo in cui il tuo viso cambia sottilmente di giorno in giorno. Ecco perché puoi farti crescere la barba, invecchiare e cambiare in altri modi sottili senza dover eseguire nuovamente la scansione del viso.

FaceID e il motore neurale studiano e imparano dal tuo viso ogni volta che sblocchi il tuo iPhone. Senza il Neural Engine, FaceID non sarebbe veloce, sicuro o affidabile la metà di quanto lo sia oggi.

Il Neural Engine gioca un ruolo chiave nelle esperienze AR su iPhone

Infine, il Neural Engine gioca un ruolo chiave nell'AR su iPhone. Per coloro che non lo sanno, la Realtà Aumentata (AR) è una funzionalità che proietta modelli 3D nel tuo ambiente attraverso il mirino della fotocamera del tuo iPhone. Puoi testarlo tu stesso utilizzando l'app Misura sul tuo iPhone.

Questo tipo di funzionalità combina cose come il riconoscimento delle immagini, la consapevolezza spaziale e la memoria. Tutto ciò richiede la potenza che il Neural Engine porta in tavola.

Fortunatamente, molte delle nuove funzionalità di iOS 15 sono destinate a rendere l'AR su iPhone ancora più potente. È una tendenza che spero continui, poiché penso che l'AR abbia il potenziale per essere una delle funzionalità più integranti dei dispositivi mobili.

Le imminenti funzionalità di iOS 15 puntano verso un futuro più intelligente per iPhone

Nel complesso, sono molto eccitato per il futuro a cui queste funzionalità di iOS 15 ci danno uno sguardo. Ci sono molte sfaccettature dell'iPhone che sembrano un po' sottoutilizzate, ma poche quanto lo è stato il Neural Engine. Non vedo l'ora di questo cambiamento, e spero che lo faccia anche tu!

Per ulteriori notizie, approfondimenti e suggerimenti su tutto ciò che riguarda Apple, dai un'occhiata al resto di il blog di AppleToolBox!