다음은 Apple이 사용자에게 가치를 제공하기 위해 증강 현실을 사용하는 방법에 대한 완벽한 예입니다.

Lyft, Uber 또는 기타 차량 공유 기능을 사용해 본 많은 사람들은 특히 혼잡한 거리에서 도착 차량을 찾는 것이 때때로 불편하다는 사실을 증명할 수 있습니다.

실수로 잘못된 차에 타거나 타려고 시도한 적이 있습니까?

운전자와 도착하는 차에 대한 설명이 훨씬 쉬워지지만 어떻게 하면 한 단계 더 올라갈 수 있을까요?

입력하다 애플의 증강현실!

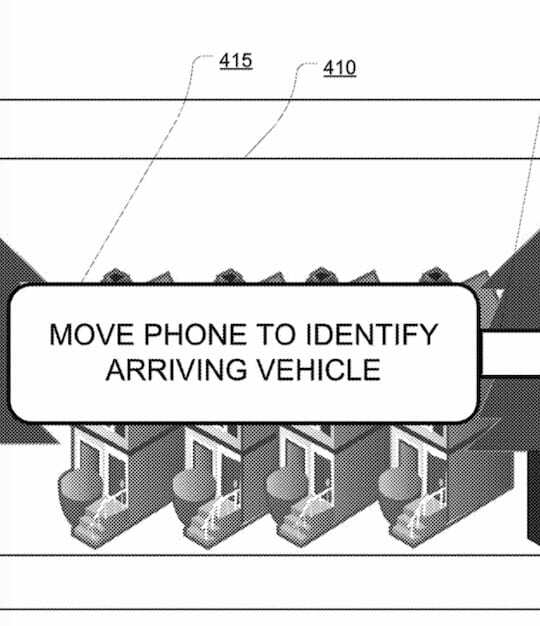

오늘 승인된 특허에 따르면 Apple의 '도착 차량 식별 촉진을 위한 증강 현실 인터페이스' 아이디어는 사용자가 모바일을 사용하여 주어진 장면에서 도착 차량을 쉽게 시각화할 수 있도록 AR 기능을 레이어링하는 것입니다. 장치.

iPhone을 사용하여 풍경을 스캔할 수 있습니다. 그런 다음 iPhone은 요청된 차량이 있는지 여부와 위치를 결정하고 모바일 장치에 요청한 차량의 표시기를 표시합니다.

유사하게, 모바일 장치는 운전자가 풍경을 스캔하는 데 사용할 수 있습니다. 모바일 장치는 승객이 어디에 있는지 여부와 위치를 결정하고 모바일 장치에 요청하는 승객의 표시자를 표시할 수 있습니다.

이를 용이하게 하기 위해 A/R을 사용하려는 Apple의 계획에는 몇 가지 분명한 이점이 있습니다.

출퇴근 시간의 사무실이나 행사가 끝나는 장소와 같이 많은 사용자가 동시에 같은 장소에서 운송을 요청하는 경우가 많습니다.

따라서 운송을 기다리는 여러 사용자가 거의 동일한 주소 또는 위치에 있을 수 있습니다.

주소보다 잠재적으로 더 정확하지만 GPS 좌표에는 작은 오류를 설명하거나 감지하지 못하는 어느 정도의 오류가 있을 수 있습니다. 다른 사용자의 위치 간의 차이(예: 건물 입구에서 북쪽으로 40피트 대 건물에서 서쪽으로 10피트) 입구). 따라서 요청한 승객은 GPS에 의해 식별된 정확한 위치에 있지 않을 수 있습니다.

증강 현실 기반 플랫폼을 제공하여 차량이나 승객의 정확한 위치를 정확히 찾아내면 훨씬 쉬워집니다.

AR 프로세스의 일부로 요청 앱(Lyft, Uber 등)은 차량이 도착했다는 알림을 iPhone으로 보낼 수 있습니다. 알림에 대한 응답으로 iPhone의 증강 현실(AR) 모드가 활성화됩니다.

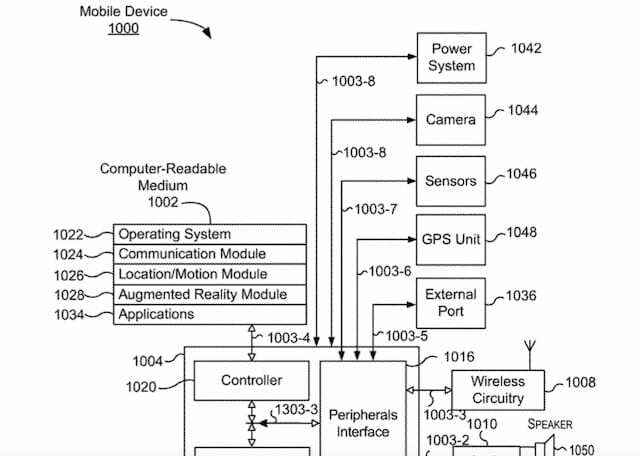

AR은 버튼을 선택하거나 모바일 장치의 지정된 제스처로 작동할 수 있습니다. 일부 경우에, 제스처는 모바일 장치의 하나 이상의 센서, 예를 들어 가속도계, 자이로스코프 등에 의해 감지될 수 있습니다.

iPhone에서 AR 모드가 활성화되면, 예를 들어 이미지에서 인식된 문자의 텍스트 분석 및/또는 물체 인식을 통해 카메라로 촬영한 이미지를 분석할 수 있습니다. 물체 인식은 이미지를 분석하여 물체에 대응하기에 충분히 큰 물체를 식별할 수 있습니다. 차량이 차량과 일치하는지 확인하기 위해 식별된 차량에 대한 추가 분석을 수행합니다. 데이터.

특허에 따라 기계 학습 모델은 객체 인식 및 분석에 사용할 수 있습니다. 텍스트 데이터 또는 색상 또는 제조사/모델에 따른 자동차 분류(예: 모형을 만들다).

또한 AR 모드는 지도 보기 내에서 작동하여 사용자가 차량에 대한 정확한 방향에 액세스하고 차량이 오는 방향을 더 쉽게 이해할 수 있도록 합니다.

이것은 Apple이 사용자의 고객 경험을 향상시키기 위해 증강 현실을 어떻게 사용할 계획인지 보여주는 많은 예 중 하나일 뿐입니다.

승인된 모든 특허와 마찬가지로 이 기능이 실제로 iPhone에 적용되는지 여부와 시기를 말하기는 어렵습니다. 그러나 Apple이 증강 현실에 중점을 두고 있고 Lyft와 같은 차량 공유 플랫폼과의 긴밀한 관계를 고려할 때 이 기능이 더 빨리 출시될 수 있다고 추측할 수 있습니다.

Apple에 A/UX가 일찍 도착했을 때부터 기술에 집착한 Sudz(SK)는 AppleToolBox의 편집 방향을 책임지고 있습니다. 그는 캘리포니아 로스앤젤레스에 거주하고 있습니다.

Sudz는 수년에 걸쳐 수십 개의 OS X 및 macOS 개발을 검토하여 macOS의 모든 것을 다루는 것을 전문으로 합니다.

전생에 Sudz는 포춘 100대 기업의 기술 및 비즈니스 혁신 열망을 도왔습니다.