We hebben contact opgenomen met Sony om wat meer te weten te komen over de IMX378-sensor die wordt gebruikt door de aankomende Google Pixel- en Pixel XL-telefoons. Leer er alles over!

IMX378-overzicht

We hebben contact opgenomen met Sony om wat meer te weten te komen over de IMX378-sensor die wordt gebruikt door de aankomende Google Pixel En PixelXL telefoons, maar ook via de Xiaomi Mi 5S. Helaas kon Sony de datasheet voor de Exmor RS IMX378-sensor nog niet distribueren, maar dat deden ze wel waren uiterst behulpzaam en konden ons voorzien van niet eerder vrijgegeven informatie over de IMX378.

Ten eerste was de naam zelf verkeerd. Ondanks geruchten dat het deel zou uitmaken van de Exmor R lijn van Backside Illuminate (BSI) CMOS-sensoren zoals de IMX377 ervoor die werd gebruikt in de Nexus5X En Nexus6P, heeft onze contactpersoon bij Sony ons laten weten dat de IMX378 in plaats daarvan zal worden beschouwd als onderdeel van Sony Exmor RS lijn gestapelde BSI CMOS-sensoren.

Hoewel veel dingen hetzelfde zijn gebleven van de IMX377 tot de IMX378, inclusief de pixelgrootte (1,55 μm) en sensorgrootte (7,81 mm), zijn er een paar belangrijke functies toegevoegd. Het is nu namelijk een gestapeld BSI CMOS-ontwerp, het heeft PDAF, het voegt Sony’s SME-HDR-technologie toe en het heeft betere ondersteuning voor video met hoge framesnelheid (slow motion).

Gestapelde BSI-CMOS

Achterkantverlichting op zichzelf is een uiterst nuttige functie die de afgelopen jaren bijna standaard is geworden in vlaggenschip-smartphones, te beginnen met de HTC Evo 4G in 2010. Hierdoor kan de camera aanzienlijk meer licht opvangen (ten koste van meer ruis) door een deel ervan te verplaatsen de structuur die traditioneel voor de fotodiode zat op aan de voorkant verlichte sensoren, daarachter Het.

Verrassend genoeg verscheen de achterverlichting, in tegenstelling tot de meeste cameratechnologie, oorspronkelijk in telefoons vóór DSLR's, grotendeels dankzij de problemen bij het maken van grotere BSI-sensoren. De eerste BSI APS-C-sensor was de Samsung S5KVB2 die uit 2014 in hun NX1-camera werd aangetroffen, en de eerste volformaat sensor was de Sony Exmor R IMX251 die vorig jaar in de Sony α7R II werd aangetroffen jaar.

De gestapelde BSI CMOS-technologie gaat nog een stap verder door een groter deel van de circuits van de voorste laag naar het ondersteunende substraat achter de fotodiodes te verplaatsen. Hierdoor kan Sony niet alleen de grootte van de beeldsensor aanzienlijk verkleinen (waardoor grotere sensoren op dezelfde voetafdruk mogelijk zijn), maar kan Sony ook de pixels en circuits afdrukken afzonderlijk (zelfs bij verschillende productieprocessen), waardoor het risico op defecten wordt verminderd, de opbrengsten worden verbeterd en meer specialisatie tussen de fotodiodes en de ondersteunende circuits.

PDAF

De IMX378 voegt fasedetectie-autofocus toe, die de Nexus-telefoons van vorig jaar en de IMX377 niet ondersteunden. Hierdoor kan de camera effectief de verschillen in lichtintensiteit tussen verschillende punten op de sensor identificeren als het object waarop de camera probeert scherp te stellen zich voor of achter het scherpstelpunt bevindt, en pas de sensor aan overeenkomstig. Dit is een enorme verbetering, zowel qua snelheid als nauwkeurigheid ten opzichte van de traditionele, op contrast gebaseerde autofocus die we in het verleden op veel camera’s hebben gezien. Als gevolg hiervan hebben we een absolute explosie gezien van het aantal telefoons dat gebruikmaakt van PDAF, en het is een enorm marketingmodewoord geworden dat in de hele branche als middelpunt van cameramarketing wordt beschouwd.

De IMX378 voegt fasedetectie-autofocus toe, die de Nexus-telefoons van vorig jaar en de IMX377 niet ondersteunden. Hierdoor kan de camera effectief de verschillen in lichtintensiteit tussen verschillende punten op de sensor identificeren als het object waarop de camera probeert scherp te stellen zich voor of achter het scherpstelpunt bevindt, en pas de sensor aan overeenkomstig. Dit is een enorme verbetering, zowel qua snelheid als nauwkeurigheid ten opzichte van de traditionele, op contrast gebaseerde autofocus die we in het verleden op veel camera’s hebben gezien. Als gevolg hiervan hebben we een absolute explosie gezien van het aantal telefoons dat gebruikmaakt van PDAF, en het is een enorm marketingmodewoord geworden dat in de hele branche als middelpunt van cameramarketing wordt beschouwd.

Hoewel hij niet zo snel scherpstelt als de Dual Photodiode PDAF die de Samsung Galaxy S7 heeft (ook bekend als “Dual Pixel PDAF” En “Duo Pixel-autofocus”), waardoor elke afzonderlijke pixel kan worden gebruikt voor fasedetectie door twee fotodiodes per pixel op te nemen, zou de fusie van PDAF en laser-autofocus nog steeds een krachtige combinatie moeten zijn.

Hoge framesnelheid

Er wordt de laatste tijd veel gesproken over camera's met een hoge framesnelheid (zowel voor consumententoepassingen als bij het maken van professionele films). De mogelijkheid om met hogere framesnelheden te fotograferen, kan zowel worden gebruikt om ongelooflijk vloeiende video's te maken normale snelheid (wat fantastisch kan zijn voor sport en andere hogesnelheidsscenario's) en om er een paar te creëren Echt interessante video's als je alles vertraagt.

Helaas is het uiterst moeilijk om video op te nemen met hogere framesnelheden, zelfs met uw camera sensor met hogere framesnelheden kan fotograferen, kan het voor de beeldsignaalprocessor van de telefoon moeilijk zijn om dit vast te houden omhoog. Dat is de reden waarom, terwijl de IMX377 die in de Nexus 5X en 6P werd gebruikt, 720p-video kon opnemen bij 300 Hz en 1080p-video bij 120 Hz, we alleen 120 Hz 720p zagen van de Nexus 5X en 240 Hz 720p van de 6P. De IMX377 was ook in staat tot 60 Hz 4k-video, ondanks dat de Nexus-apparaten beperkt waren tot 30 Hz.

De Pixel-telefoons kunnen dit beide tot 120 Hz 1080p-video en 240 Hz 720p-video brengen, dankzij onderdeel van verbeteringen gerelateerd aan de IMX378, die een toename in mogelijkheden ziet tot 240 Hz bij 1080p.

De sensor kan ook sneller burst-opnamen maken met volledige resolutie, oplopend tot 60 Hz bij 10 bit output en 40 Hz bij 12 bit uitgangssignaal (van respectievelijk 40 Hz en 35 Hz), wat de hoeveelheid bewegingsonscherpte en cameratrillingen zou moeten helpen verminderen bij gebruik HDR+.

MKB-HDR

Traditioneel was HDR voor video een afweging. Je moest óf de framesnelheid halveren, óf je moest de resolutie halveren. Als gevolg hiervan hebben veel OEM's zich er niet eens mee bezig gehouden, waarbij Samsung en Sony tot de weinigen behoren die het wel implementeren. Zelfs de Samsung Galaxy Note 7 is beperkt tot 1080p 30 Hz-opnamen, gedeeltelijk vanwege de hoge rekenkosten van HDR-video.

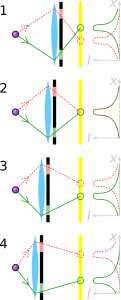

De eerste van de twee belangrijkste traditionele methoden voor HDR-video, die Red Digital Cinema Camera Company noemt HDRx en die Sony Digital Overlap HDR noemt (DOL-HDR), werkt door twee opeenvolgende beelden te nemen, één donkerder belicht en één lichter belicht, en deze samen te voegen om één videoframe te creëren. Hoewel je hierdoor de volledige resolutie van de camera kunt behouden (en verschillende sluitertijden voor de twee afzonderlijke kunt instellen). frames), kan dit vaak tot problemen leiden vanwege het tijdsverschil tussen de twee frames (vooral bij snel bewegende beelden). voorwerpen). Bovendien kan het voor de processor erg moeilijk zijn om het bij te houden, omdat bij DOL-HDR de ISP van de telefoon de afzonderlijke frames samenvoegt.

De andere traditionele methode, die Sony Binning Multiplexed Exposure HDR (BME-HDR) noemt, stelt een andere belichtingsinstelling in voor elk paar van twee lijnen pixels in de sensor om tegelijkertijd twee beelden met een halve resolutie te creëren, die vervolgens worden samengevoegd tot één HDR-frame voor de video. Hoewel deze methode de problemen vermijdt die verband houden met HDRx, namelijk een verlaging van de framesnelheid, kent deze ook andere problemen: met name de vermindering van de resolutie en de limieten voor hoe de belichting tussen de twee sets kan worden gewijzigd lijnen.

Spatially Multiplexed Exposure (SME-HDR) is een nieuwe methode die Sony gebruikt om HDR-opnamen te maken met de volledige resolutie en de volledige framesnelheid waartoe de sensor in staat is. Het is een variant van Ruimtelijk variërende belichting dat gebruik maakt van eigen algoritmen waarmee Sony de informatie van de donkere en lichte pixels kan vastleggen gerangschikt in een dambordpatroon, en leidt hieruit het beeld met volledige resolutie af voor zowel de donkere als de lichte belichting afbeeldingen.

Helaas was Sony niet in staat ons meer gedetailleerde uitleg te geven over het exacte patroon, en misschien zullen ze het ook nooit vrijgeven; bedrijven hebben de neiging hun kaarten te spelen heel dicht bij hun borst als het gaat om geavanceerde technologie, zoals die we zien in HDR, waarbij zelfs Google zijn eigen gepatenteerde algoritme voor HDR-foto's heeft, bekend als HDR+. Er is echter nog steeds enige openbaar beschikbare informatie die we kunnen gebruiken om samen te vatten hoe dit kan worden bereikt. Er zijn een aantal artikelen gepubliceerd door Shree K. Nayar van Columbia Universiteit (een daarvan was in samenwerking met Tomoo Mitsunaga van Sony) die verschillende manieren bevatten om ruimtelijk variërende belichting te gebruiken, en verschillende lay-outs waarmee dit kan worden bereikt. Hieronder ziet u een voorbeeld van een lay-out met vier belichtingsniveaus op een RGBG-beeldsensor. Deze lay-out beweert HDR-afbeeldingen met volledige resolutie in één opname te kunnen maken met slechts ongeveer 20% verlies in ruimtelijke resolutie, afhankelijk van het scenario (dezelfde prestatie waar Sony voor beweert MKB-HDR).

Sony heeft SME-HDR al in een aantal beeldsensoren gebruikt, waaronder in de IMX214 die de laatste tijd veel populariteit heeft gekend (wordt gebruikt in de Asus Zenfone 3 Laser, de Moto Z, en de Xperia X-prestaties), maar is een nieuwe toevoeging aan de IMX378 vergeleken met de IMX377 die vorig jaar werd gebruikt. Hierdoor kan de camerasensor zowel 10 bit volledige resolutie als 4K-video bij 60 Hz uitvoeren met SME-HDR actief. Hoewel een knelpunt elders in het proces zal resulteren in een ondergrens, is dit een fantastische verbetering ten opzichte van waartoe de IMX377 in staat was, en een teken van goede dingen die in de toekomst zullen gebeuren.

Een van de grote verbeteringen van de IMX378 ten opzichte van de IMX377 is dat deze een groter deel van de beeldverwerking op de chip kan verwerken, waardoor er minder de werklast van de ISP (hoewel de ISP nog steeds de RAW-beeldgegevens kan opvragen, afhankelijk van hoe de OEM besluit de sensor). Het kan veel kleine zaken aan, zoals defectcorrectie en lokaal spiegelen, maar wat nog belangrijker is, het kan ook overweg met BME-HDR of SME-HDR zonder dat de ISP erbij betrokken hoeft te worden. Dat zou in de toekomst mogelijk een groot verschil kunnen betekenen doordat er op toekomstige telefoons wat overhead voor de ISP vrijkomt.

We willen Sony nogmaals bedanken voor alle hulp bij het maken van dit artikel. We waarderen enorm de moeite die Sony heeft gedaan om de nauwkeurigheid en diepgang hiervan te helpen garanderen functie, vooral omdat het ons in staat stelt om eerder niet eerder vrijgegeven informatie over de IMX378.

Dat gezegd hebbende, is het echt jammer dat het zo moeilijk is om toegang te krijgen tot een deel van deze informatie, zelfs tot basisproductinformatie. Wanneer bedrijven informatie op hun websites proberen te plaatsen, kan deze in grote lijnen vaak tamelijk ontoegankelijk en onvolledig zijn deels omdat het vaak wordt behandeld als een secundaire zorg van de werknemers van het bedrijf, die zich meer op hun belangrijkste zaken concentreren werk. Eén toegewijde persoon die de public relations verzorgt, kan een enorm verschil maken als het gaat om het maken van dit soort informatie beschikbaar en toegankelijk voor het grote publiek, en we zien dat sommige mensen precies dat in hun vrije tijd proberen te doen tijd. Zelfs op de Sony Exmor Wikipedia-artikel zelf, waar in de loop van een paar maanden één persoon in zijn vrije tijd het grootste deel van de basis legde om het over te nemen van een bijna nutteloze Artikel van 1.715 bytes dat was al jaren grotendeels hetzelfde, in het artikel van ongeveer 50.000 bytes dat we daar vandaag de dag zien met 185 verschillende redacteuren. Een artikel dat misschien wel de beste informatiebron is over de Sony Exmor-sensorlijn die online beschikbaar is, en we kunnen een vergelijkbaar patroon zien in andere artikelen. Eén enkele toegewijde schrijver kan een substantieel verschil maken in hoe gemakkelijk klanten verschillende producten met elkaar kunnen vergelijken producten, en hoe goed geïnformeerde, geïnteresseerde consumenten zijn over het onderwerp, wat verstrekkende gevolgen kan hebben Effecten. Maar dat is een onderwerp voor een andere keer.

Zoals altijd vragen we ons af hoe deze hardwarewijzigingen de apparaten zelf zullen beïnvloeden. We zullen duidelijk geen 4K 60 Hz HDR-video krijgen (en misschien helemaal geen HDR-video, aangezien Google dit nog niet heeft genoemd), maar de snellere volledige resolutie fotograferen zal waarschijnlijk aanzienlijk helpen met HDR +, en we zullen de verbeteringen van de nieuwere sensor op andere soortgelijke kleine maar substantiële manieren in de telefoon zien druppelen ook.

Terwijl DXOMark vermeldt de Pixel telefoons presteerden iets beter dan de Samsung Galaxy S7 en HTC 10, veel van de dingen die de Pixel-telefoons een kleine voorsprong gaven, waren grote software verbeteringen zoals HDR+ (dat absoluut fantastische resultaten oplevert, en waar DXOMark een heel deel van hun recensie aan wijdde) en de speciale EIS van Google systeem (dat samen kan werken met OIS) dat de gyroscoop 200 keer per seconde bemonstert om de beste elektronische beeldstabilisatie te bieden die we ooit hebben gehad gezien. Ja, de Pixel-telefoons hebben een geweldige camera, maar hadden ze nog beter kunnen zijn als OIS en Dual Pixel PDAF waren toegevoegd? Absoluut.

Begrijp me niet verkeerd, zoals ik al zei, de Pixel-telefoons hebben een absoluut verbluffende camera, maar je kunt het mij niet echt kwalijk nemen dat ik meer wil, vooral niet wanneer het pad naar die verbeteringen zo duidelijk is (en wanneer de telefoons geprijsd zijn tegen de volledige vlaggenschipprijs, waarbij je het beste van de markt verwacht best). Er zal altijd een deel van mij zijn dat meer wil, een betere batterijduur, snellere processors, een betere batterijduur, helderder en levendigere schermen, luidere luidsprekers, betere camera's, meer opslagruimte, een betere levensduur van de batterij en, belangrijker nog, een betere levensduur van de batterij (opnieuw). Dat gezegd hebbende, hebben de Pixel-telefoons veel kleine fantastische functies die samen een werkelijk veelbelovend apparaat kunnen vormen, en ik ben blij om te zien.