Wczoraj Google zaprezentował kilka bardzo interesujących nowych funkcji na konferencji Google I/O. Firma uruchomiła teraz funkcję asystenta głosowego na iPhonie, a także jest w trakcie uruchamiania samodzielnych zestawów słuchawkowych do rzeczywistości wirtualnej. Ogłoszenie, które nas wyróżniało, to wprowadzenie nowatorskiej funkcji Google Lens.

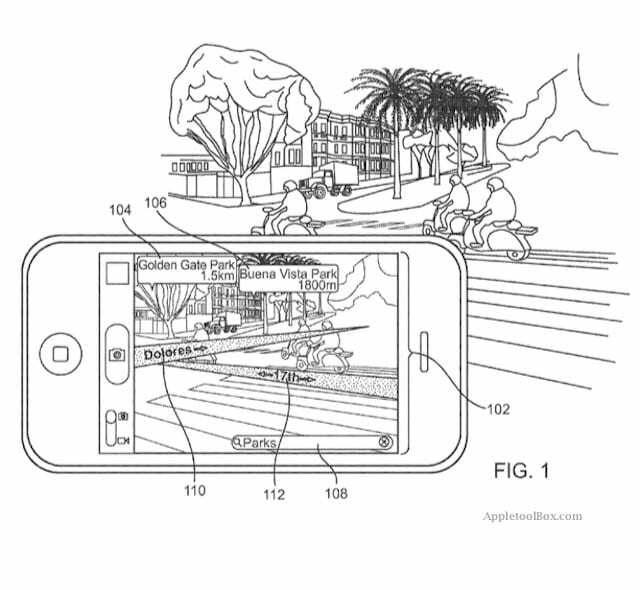

Ta nowa funkcja pokazuje integrację mocy aparatu smartfona z rozpoznawaniem obrazu i wyświetlaniem informacji kontekstowych.

Aplikacja obiektywu Google wykorzystuje rozpoznawanie obrazu do identyfikowania obiektów pojawiających się w obiektywie aparatu w czasie rzeczywistym. Aplikacja analizuje otoczenie i wyświetla odpowiednie informacje na ekranie.

Po skierowaniu telefonu na witrynę sklepową zobaczysz ocenę restauracji, menu lub natychmiastowe recenzje. Możesz skierować go na kwiat i zidentyfikuje gatunek, a nawet możesz wyświetlić muzykę lub wideo zespołu, wskazując obiektywem na koncercie plakat.

Biorąc pod uwagę nową moc przetwarzania smartfonów nowej generacji wraz z potężnym obiektywem aparatu, może to otworzyć się na cały nowy świat interakcji człowieka z komputerem i spraw, aby rozszerzona rzeczywistość znalazła się przed i pośrodku naszego smartfona doświadczenie.

Gdy Apple przygotowuje się do uruchomienia iPhone’a 8 i iOS 11, zastanawiamy się, czy miał wystarczająco dużo czasu na zintegrowanie jednego z kluczowych przejęć z poprzednich lat, aby zapewnić podobne wrażenia na iPhonie.

Firma Apple nabyła Metaio w maju 2015 roku. Podobnie jak inne małe przejęcia Apple, nie było żadnych fanfar, ponieważ metaio zostało wchłonięte przez działalność Apple. metaio był startupem z pewną historią. Został uruchomiony w 2003 roku jako odgałęzienie projektu Volksvagen. W momencie przejęcia metaio miało blisko 1000 klientów i 150 000 użytkowników. Większość ofert skupiała się na przypadkach użycia B2B.

Firma była jednym z pierwszych małych, ale odnoszących sukcesy graczy w świecie rozszerzonej rzeczywistości.

Sposób działania platformy był bardzo podobny do tego, co można znaleźć w Google Lens. Skieruj kamerę iOS na obiekt fizyczny, a system utworzy dodatkowe informacje kontekstowe dotyczące obiektu uchwyconego w czasie rzeczywistym w obiektywie.

Klasyczny przypadek użycia tej platformy można zobaczyć w tym filmie, w którym użytkownicy wskazują iPada podczas odwiedzania miejsca pamięci Muru Berlińskiego, a aplikacja wyświetla na ekranie historyczne nagrania.

Firma udostępniła również demo, które zaprezentowało niektóre przypadki użycia na wzór tego, co widzisz w obiektywie Google. Na przykład skieruj aparat na sklep detaliczny, a wyświetli on różne bieżące promocje i rabaty, które oferuje sklep.

metaio dostarczyło łatwą i bezproblemową platformę, która umożliwiła użytkownikom tworzenie aplikacji rozszerzonej rzeczywistości w ciągu kilku minut. Dzięki kreatorowi metaio możesz tworzyć i wdrażać aplikacje na macOS i iOS. Firma oferowała również system oparty na chmurze o nazwie Metaio CVS, który umożliwiał dopasowywanie obrazów w chmurze.

Przejęcie przez Apple metaio w 2015 roku było zdecydowanie bardzo strategiczną grą. Kiedy połączysz to, co zrobiła ta mała firma, z dużymi badaniami i rozwojem, które Apple prowadzi we własnym zakresie, trudno nie ekscytować się myśleniem o potencjalnych ofertach.

Apple od dłuższego czasu pracuje nad wizją komputerową, dopasowywaniem wzorców i uczeniem maszynowym. Peter Meier, współzałożyciel metaio, nadal pracuje dla Apple w dziale inżynierii wraz z Thomasem Altem, drugim współzałożycielem, który obecnie jest członkiem zespołu ds. transakcji strategicznych w Apple.

W zeszłym roku, kiedy iOS 10 został zaprezentowany na WWDC, mieliśmy nadzieję, że zobaczymy niektóre z możliwości rzeczywistości mieszanej. Cóż, to się nie stało. Wiele zeszłorocznych WWDC skupiło się na przeprojektowanych możliwościach iMessage wraz z przeprojektowanym interfejsem iOS

Mamy nadzieję, że tegoroczne WWDC ma więcej do zaoferowania, zwłaszcza w tej rozwijającej się dziedzinie rozpoznawania obrazu. To nie może być tylko pobożne życzenie, ponieważ Apple już pracuje nad tą technologią poprzez przejęcia i wewnętrzne badania.

Teraz, gdy zaprezentowano Obiektyw Google, najwyższy czas, aby Apple zaprezentowało swój najlepszy program na czerwcowym festiwalu WWDC.

Będziemy czekać!

Firma Sudz (SK), mająca obsesję na punkcie technologii od początku pojawienia się A/UX w Apple, jest odpowiedzialna za kierownictwo redakcyjne AppleToolBox. Mieszka w Los Angeles w Kalifornii.

Sudz specjalizuje się we wszystkich rzeczach związanych z macOS, po przejrzeniu dziesiątek zmian OS X i macOS na przestrzeni lat.

W poprzednim życiu Sudz pomagał firmom z listy Fortune 100 w ich aspiracjach związanych z technologią i transformacją biznesową.