Vi tog kontakt med Sony för att försöka lära oss lite mer om IMX378-sensorn som används av de kommande Google Pixel- och Pixel XL-telefonerna. Lär dig allt om det!

IMX378 Översikt

Vi tog kontakt med Sony för att försöka lära oss lite mer om IMX378-sensorn som används av den kommande Google Pixel och Pixel XL telefoner, samt av Xiaomi Mi 5S. Tyvärr har Sony inte kunnat distribuera databladet för Exmor RS IMX378-sensorn ännu, men de var oerhört hjälpsamma och kunde förse oss med lite tidigare outgiven information om IMX378.

För det första var själva namnet fel. Trots rykten om att det skulle vara en del av Exmor R linje av Backside Illuminated (BSI) CMOS-sensorer som IMX377 innan den som användes i Nexus 5X och Nexus 6P, har vår kontakt på Sony informerat oss om att IMX378 istället kommer att betraktas som en del av Sonys Exmor RS rad staplade BSI CMOS-sensorer.

Även om många saker har förblivit desamma från IMX377 till IMX378, inklusive pixelstorleken (1,55 μm) och sensorstorleken (7,81 mm), har det lagts till ett par viktiga funktioner. Det är nämligen nu en staplad BSI CMOS-design, den har PDAF, den lägger till Sonys SME-HDR-teknik och den har bättre stöd för video med hög bildhastighet (slow motion).

Staplad BSI CMOS

Baksidesbelysning i sig är en extremt användbar funktion som har blivit nästan standard i flaggskeppssmartphones de senaste åren, med början HTC Evo 4G år 2010. Det gör att kameran kan fånga avsevärt mer ljus (till bekostnad av mer brus) genom att flytta en del av den strukturen som traditionellt satt framför fotodioden på främre upplysta sensorer, bakom Det.

Överraskande nog, till skillnad från de flesta kameratekniker, började baksidesbelysning ursprungligen dyka upp i telefoner före DSLR: er, till stor del tack vare svårigheterna med att skapa större BSI-sensorer. Den första BSI APS-C-sensorn var Samsung S5KVB2 som hittades i deras NX1-kamera från 2014, och den första fullformatssensorn var Sony Exmor R IMX251 som hittades i Sony α7R II från sist år.

Stacked BSI CMOS-teknik tar detta ett steg längre genom att flytta mer av kretsarna från det främre lagret till det stödjande substratet bakom fotodioderna. Detta gör det inte bara möjligt för Sony att avsevärt minska storleken på bildsensorn (medger större sensorer i samma fotavtryck), utan gör det också möjligt för Sony att skriva ut pixlarna och kretsarna separat (även vid olika tillverkningsprocesser), vilket minskar risken för defekter, förbättrar utbyten och möjliggör mer specialisering mellan fotodioderna och de stödjande kretsar.

PDAF

IMX378 lägger till Fasdetekteringsautofokus, som förra årets Nexus-telefoner och IMX377 inte stödde. Det gör att kameran effektivt kan använda skillnaderna i ljusintensitet mellan olika punkter på sensorn för att identifiera om objektet som kameran försöker fokusera på är framför eller bakom fokuspunkten, och justera sensorn följaktligen. Detta är en enorm förbättring både vad gäller hastighet och noggrannhet jämfört med den traditionella kontrastbaserade autofokusen som vi har sett på många kameror tidigare. Som ett resultat har vi sett en absolut explosion av telefoner som använder PDAF, och det har blivit ett enormt marknadsföringsbuzzword som hålls fram som en central del av kameramarknadsföring över hela branschen.

IMX378 lägger till Fasdetekteringsautofokus, som förra årets Nexus-telefoner och IMX377 inte stödde. Det gör att kameran effektivt kan använda skillnaderna i ljusintensitet mellan olika punkter på sensorn för att identifiera om objektet som kameran försöker fokusera på är framför eller bakom fokuspunkten, och justera sensorn följaktligen. Detta är en enorm förbättring både vad gäller hastighet och noggrannhet jämfört med den traditionella kontrastbaserade autofokusen som vi har sett på många kameror tidigare. Som ett resultat har vi sett en absolut explosion av telefoner som använder PDAF, och det har blivit ett enormt marknadsföringsbuzzword som hålls fram som en central del av kameramarknadsföring över hela branschen.

Även om den inte är lika snabb att fokusera som Dual Photodiode PDAF Samsung Galaxy S7 har (även känd som "Dual Pixel PDAF" och "Duo Pixel Autofokus"), vilket gör att varje enskild pixel kan användas för fasdetektering genom att inkludera två fotodioder per pixel, bör sammanslagningen av PDAF och laserautofokus fortfarande vara en potent kombination.

Hög bildfrekvens

Det har pratats mycket på sistone om kameror med hög bildhastighet (både för konsumenttillämpningar och inom professionell filmskapande). Att kunna fotografera med högre bildfrekvenser kan användas både för att skapa otroligt smidiga videor vid vanlig hastighet (vilket kan vara fantastiskt för sport och andra höghastighetsscenarier) och för att skapa några verkligen intressanta videor när du saktar ner allt.

Tyvärr är det extremt svårt att spela in video med högre bildhastigheter, och även när din kamera sensor kan fotografera med högre bildhastigheter, kan det vara svårt för telefonens bildsignalprocessor att behålla upp. Det är därför medan IMX377 som används i Nexus 5X och 6P kunde spela in 720p-video vid 300 Hz och 1080p-video vid 120 Hz, såg vi bara 120 Hz 720p från Nexus 5X och 240 Hz 720p från 6P. IMX377 var också kapabel till 60 Hz 4k-video, trots att Nexus-enheterna var begränsade till 30 Hz.

Pixel-telefonerna kan både ge denna upp till 120 Hz 1080p-video och 240 Hz 720p-video tack vare del till förbättringar relaterade till IMX378, som ser en ökning av kapaciteten på upp till 240 Hz vid 1080p.

Sensorn kan också ta fullupplösta seriebilder snabbare, steg upp till 60 Hz vid 10 bitars utgång och 40 Hz vid 12 bitar utsignal (upp från 40 Hz respektive 35 Hz), vilket bör bidra till att minska mängden rörelseoskärpa och kameraskakning vid användning HDR+.

SME-HDR

Traditionellt har HDR för video varit en avvägning. Antingen var du tvungen att halvera bildhastigheten eller så var du tvungen att halvera upplösningen. Som ett resultat har många OEM-tillverkare inte ens brytt sig om det, med Samsung och Sony är bland de få som implementerar det. Även Samsung Galaxy Note 7 är begränsad till 1080p 30 Hz-inspelning, delvis på grund av den höga beräkningskostnaden för HDR-video.

Den första av de två huvudsakliga traditionella metoderna för HDR-video, som Red Digital Cinema Camera Company kallar HDRx och som Sony kallar Digital Overlap HDR (DOL-HDR), fungerar genom att ta två på varandra följande bilder, en exponerad mörkare och en exponerad ljusare, och slå samman dem för att skapa en enda videoram. Medan detta låter dig behålla kamerans fulla upplösning (och ställa in olika slutartider för de två separata ramar), kan det ofta leda till problem på grund av tidsskillnaden mellan de två bildrutorna (särskilt med snabba rörelser föremål). Dessutom kan det vara väldigt svårt för processorn att hänga med, eftersom med DOL-HDR hanterar telefonens ISP att slå ihop de separata ramarna.

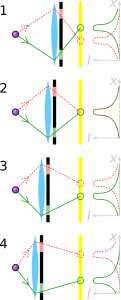

Den andra traditionella metoden, som Sony kallar Binning Multiplexed Exposure HDR (BME-HDR), anger en annan exponeringsinställning för varje par av två rader med pixlar i sensorn för att skapa två halvupplösningsbilder samtidigt, som sedan slås samman till en HDR-bildruta för videon. Även om den här metoden undviker problemen med HDRx, nämligen en minskning av bildhastigheten, har den andra problem, specifikt minskningen av upplösningen och gränserna för hur exponeringen kan ändras mellan de två uppsättningarna av rader.

Spatial Multiplexed Exposure (SME-HDR) är en ny metod som Sony använder för att göra det möjligt för dem att fotografera HDR med den fulla upplösningen och med den fulla bildhastighet som sensorn kan. Det är en variant av Rumsligt varierande exponering som använder proprietära algoritmer för att låta Sony fånga informationen från de mörka och ljusa pixlarna, som är arrangerade i ett rutmönster och dra slutsatsen att bilden i full upplösning för både mörk och ljus exponering bilder.

Tyvärr kunde Sony inte ge oss mer detaljerade förklaringar om det exakta mönstret, och de kanske aldrig kan avslöja det - företag tenderar att spela sina kort väldigt nära bröstet när det kommer till spjutspetsteknologi, som den vi ser i HDR, med till och med Google som har sin egen algoritm för HDR-foton, känd som HDR+. Det finns fortfarande en del offentligt tillgänglig information som vi kan använda för att sammanställa hur det kan åstadkommas. Ett par artiklar har publicerats av Shree K. Nayar från Columbia University (varav en var i samarbete med Tomoo Mitsunaga från Sony) som innehåller olika sätt att använda Spatial Varying Exposure, och olika layouter som kan uppnå det. Nedan är ett exempel på en layout med fyra exponeringsnivåer på en RGBG-bildsensor. Den här layouten påstår sig kunna uppnå enstaka bilder i full upplösning med HDR-bilder med endast cirka 20 % förlust i rumslig upplösning, beroende på scenariot (samma prestation som Sony hävdar för SME-HDR).

Sony har redan använt SME-HDR i ett par bildsensorer, inklusive i IMX214 som har sett mycket popularitet på sistone (används i Asus Zenfone 3 Laser, den Moto Z, och den Xperia X Performance), men är ett nytt tillägg till IMX378 jämfört med IMX377 som användes förra året. Den låter kamerasensorn mata ut både 10-bitars full upplösning och 4k-video vid 60 Hz med SME-HDR aktiv. Medan en flaskhals på andra ställen i processen kommer att resultera i en lägre gräns, är detta en fantastisk förbättring jämfört med vad IMX377 var kapabel till, och är ett tecken på bra saker som kommer i framtiden.

En av de stora förbättringarna av IMX378 jämfört med IMX377 är att den kan hantera mer av bildbehandlingen på chipet, vilket minskar ISP: ns arbetsbelastning (även om ISP: n fortfarande kan begära RAW-bilddata, beroende på hur OEM bestämmer sig för att använda sensor). Den kan hantera många små saker som defektkorrigering och spegling lokalt, men ännu viktigare, den kan också hantera BME-HDR eller SME-HDR utan att behöva involvera ISP: n. Det kan potentiellt vara en stor skillnad framöver genom att frigöra lite overhead för ISP på framtida telefoner.

Vi vill tacka Sony än en gång för all hjälp med att skapa den här artikeln. Vi uppskattar verkligen de ansträngningar som Sony gjorde för att säkerställa noggrannheten och djupet i detta funktion, särskilt genom att tillåta oss att avslöja en del tidigare outgiven information om IMX378.

Med detta sagt är det verkligen synd att det är så svårt att komma åt en del av denna information, även grundläggande produktinformation. När företag försöker sätta information på sina webbplatser kan den ofta vara ganska otillgänglig och ofullständig, i stort sett del eftersom det ofta behandlas som en sekundär angelägenhet för företagets anställda, som är mer fokuserade på sitt huvudsakliga arbete. En dedikerad person som hanterar PR kan göra en enorm skillnad när det gäller att skapa denna typ av information tillgängligt och tillgängligt för allmänheten, och vi ser några människor som försöker göra just det gratis tid. Även på Sony Exmor Wikipedia-artikeln i sig, där under loppet av ett par månader en enda person på sin fritid lade det mesta av grunden för att ta den från en nästan värdelös Artikel på 1 715 byte som hade varit mestadels densamma i flera år, till artikeln om ~50 000 byte som vi ser där idag med 185 distinkta redaktörer. En artikel som utan tvekan är det bästa arkivet med information om Sony Exmor-sensorlinjen tillgänglig online, och vi kan se ett mycket liknande mönster på andra artiklar. En enda dedikerad skribent kan göra stor skillnad i hur lätt kunderna kan jämföra olika produkter, och i hur utbildade intresserade konsumenter är om ämnet, vilket kan ha långtgående effekter. Men det är ett ämne för en annan gång.

Som alltid undrar vi hur dessa hårdvaruförändringar kommer att påverka själva enheterna. Vi kommer helt klart inte att få 4k 60 Hz HDR-video (och kanske inte får HDR-video alls, eftersom Google inte har nämnt det ännu), men den snabbare fullupplösningen fotografering kommer sannolikt att hjälpa avsevärt med HDR+, och vi kommer att se förbättringarna av den nyare sensorn sippra in i telefonen på andra liknande små men betydande sätt också.

Medan DXOMark listar Pixel telefoner som presterade något bättre än Samsung Galaxy S7 och HTC 10, många av de saker som gav Pixel-telefonerna det lilla försprånget var stor programvara förbättringar som HDR+ (som ger helt fantastiska resultat, och som DXOMark dedikerade en hel del av sin recension till) och Googles speciella EIS system (som kan fungera tillsammans med OIS) som samplar gyroskopet 200 gånger i sekunden för att ge några av den bästa elektroniska bildstabiliseringen vi någonsin har sett. Ja, Pixel-telefonerna har en fantastisk kamera, men kunde de ha varit ännu bättre med OIS och Dual Pixel PDAF lagt till? Absolut.

Missförstå mig inte, som jag sa, Pixel-telefonerna har en helt fantastisk kamera, men du kan inte klandra mig för att jag vill ha mer, speciellt när vägen till dessa förbättringar är så tydlig (och när telefonerna är prissatta till fulla flaggskeppspriser, där du förväntar dig det bästa av bäst). Det kommer alltid att finnas en del av mig som vill ha mer, som vill ha bättre batteritid, snabbare processorer, bättre batteritid, ljusare och mer levande skärmar, högre högtalare, bättre kameror, mer lagring, bättre batteritid och viktigast av allt, bättre batteritid (igen). Med det sagt, Pixel-telefonerna har många små fantastiska funktioner som kan kombineras för att skapa en verkligt lovande enhet, vilket jag är exalterad över att se.