ระหว่างดู คำปราศรัย WWDC21 ไม่กี่สัปดาห์ก่อน ฉันเริ่มสังเกตเห็นธีมที่เกิดซ้ำ และธีมดังกล่าวก็คือฟีเจอร์ต่างๆ ของ iOS 15 ที่กำลังจะมีขึ้นดูเหมือนว่าจะใช้ประโยชน์จาก Neural Engine ของ iPhone

Neural Engine อยู่ใน iPhone ตั้งแต่เปิดตัว iPhone X ในปี 2560 อย่างไรก็ตาม ฉันไม่คิดว่าพวกเราส่วนใหญ่รู้สึกถึงผลกระทบของโปรเซสเซอร์นี้เลยตลอดสี่ปีนับตั้งแต่เปิดตัวครั้งแรก

WWDC21 ทำให้ฉันรู้สึกว่า iOS 15 เป็นการอัปเดต iOS แห่งอนาคตครั้งแรกในระยะเวลานาน และถึงแม้ว่าจะไม่มีการยืนยันอย่างเป็นทางการจาก Apple เกี่ยวกับเรื่องนี้ แต่ฉันเชื่อว่าเป็นเพราะในที่สุด Apple ก็ใช้ประโยชน์จาก Neural Engine อย่างเต็มที่

ในโพสต์นี้ ฉันจะอธิบายสั้น ๆ ว่า Neural Engine คืออะไร จากนั้นฉันจะเจาะลึกฟีเจอร์ iOS 15 ใหม่ทั้งหมดที่ดูเหมือนว่าจะใช้โปรเซสเซอร์นี้อย่างเต็มศักยภาพ ในตอนท้าย ฉันจะอธิบายวิธีหลักๆ ที่ iOS ใช้ Neural Engine ในปัจจุบัน เพื่อให้คุณสามารถเปรียบเทียบกับ iOS 15 ที่กำลังจะออกวางจำหน่าย

เอาล่ะ เข้าเรื่องกันเลย!

สารบัญ

- Neural Engine บน iPhone คืออะไร?

-

ฟีเจอร์ของ iOS 15 เริ่มใช้ประโยชน์จากเอ็นจิ้นประสาทได้อย่างไร

- iPhone ของคุณสามารถอ่านข้อความในรูปภาพของคุณได้

- คุณสมบัติของ iOS 15 จะทำให้ iPhone ของคุณรู้จักและระบุเนื้อหาในรูปภาพของคุณ

- ความทรงจำในรูปภาพจะดูซับซ้อนและให้ความรู้สึก "ของจริง" มากขึ้น

- การแจ้งเตือน วิดเจ็ต และห้ามรบกวนกำลังฉลาดขึ้น

- ฟีเจอร์ใหม่ของ iOS 15 จะทำให้ขอเส้นทางด้วยกล้องของคุณได้ง่ายขึ้น

- Siri จะทำการประมวลผลบนอุปกรณ์ของคุณมากขึ้น

-

Neural Engine สามารถทำอะไรได้บ้างหากไม่มีฟีเจอร์ iOS 15 ที่กำลังจะมีขึ้น

- Neural Engine ช่วยให้คุณถ่ายภาพได้ดีขึ้น

- การเรียนรู้ของเครื่องทำให้ FaceID รวดเร็ว ปลอดภัย และปรับเปลี่ยนได้

- Neural Engine มีบทบาทสำคัญในประสบการณ์ AR บน iPhone

-

ฟีเจอร์ iOS 15 ที่กำลังจะมาถึงชี้ไปที่อนาคตอันชาญฉลาดสำหรับ iPhone

- กระทู้ที่เกี่ยวข้อง:

Neural Engine บน iPhone คืออะไร?

Neural Engine คือโปรเซสเซอร์บน iPhone X และใหม่กว่าที่จัดการการทำงานของแมชชีนเลิร์นนิง ความสามารถของโปรเซสเซอร์นี้ในการขับเคลื่อนแมชชีนเลิร์นนิ่งมีความสำคัญมาก ดังนั้นการทำความเข้าใจแมชชีนเลิร์นนิงจึงมีความสำคัญต่อการทำความเข้าใจโปรเซสเซอร์นี้

แมชชีนเลิร์นนิงหมายถึงซอฟต์แวร์ที่ทำการตัดสินใจเกี่ยวกับโค้ดที่จะรันโดยไม่ขึ้นกับโปรแกรมเมอร์

โดยปกติ ซอฟต์แวร์จำเป็นต้องทำงานกับข้อมูลที่เฉพาะเจาะจงและควบคุมได้ นั่นคือเหตุผลที่ Siri จะเข้าใจเจตนาของคุณด้วยวลีหนึ่งแต่จะไม่เข้าใจอีกวลีหนึ่ง แม้ว่าเจตนาในแต่ละวลีจะเหมือนกันก็ตาม Siri ต้องการให้ข้อมูลมีโครงสร้างเฉพาะ มิฉะนั้น อาจล้มเหลว

แมชชีนเลิร์นนิงเป็นวิธีหนึ่งที่จะเปลี่ยนแปลงสิ่งนั้น อนุญาตให้ซอฟต์แวร์รับข้อมูลที่มีโครงสร้างน้อยกว่าและยังคงประมวลผล หากคุณเคยพบว่าตัวเองประหลาดใจที่ Siri เข้าใจคำขอที่ใช้วลีแปลกๆ อาจเป็นเพราะความสามารถในการเรียนรู้ของเครื่องของ Siri นั้นได้รับการปรับปรุง

Neural Engine เป็นกลไกในโทรศัพท์ของคุณที่ทำให้สิ่งนี้เป็นไปได้

ฉันตระหนักดีว่าแนวคิดเหล่านี้อาจเข้าใจยากสักหน่อย และฉันรู้ว่าฉันอาจอธิบายได้ไม่ดีที่สุด ฉันพยายามทำให้สั้นและเรียบง่ายสำหรับโพสต์นี้ แต่ถ้าคุณต้องการเจาะลึกคุณควรตรวจสอบ โพสต์นี้!

ฟีเจอร์ของ iOS 15 เริ่มใช้ประโยชน์จากเอ็นจิ้นประสาทได้อย่างไร

ปัญหาเกี่ยวกับ Neural Engine ของ iPhone ไม่ใช่ว่ามันไม่ทรงพลัง แต่พลังของมันไม่ได้ถูกใช้อย่างเต็มที่บน iPhone ในช่วงสี่ปีที่ผ่านมา มีการใช้งานในบางกรณี เช่น เทคโนโลยีความจริงเสริม มีประโยชน์ แต่ยังไม่ได้ปฏิวัติ iPhone

ฉันคิดว่าฟีเจอร์ต่างๆ ของ iOS 15 ชี้ให้เห็นถึงอนาคตที่ปฏิวัติวงการมากขึ้นสำหรับ Neural Engine ฉันไม่คิดว่าคุณสมบัติใหม่ใด ๆ ที่ฉันกำลังจะแบ่งด้านล่างจะเป็นไปได้หากไม่มีโปรเซสเซอร์นี้ มาดูกันว่าฟีเจอร์เหล่านี้ใช้ Neural Engine อย่างเต็มที่ได้อย่างไร

iPhone ของคุณสามารถอ่านข้อความในรูปภาพของคุณได้

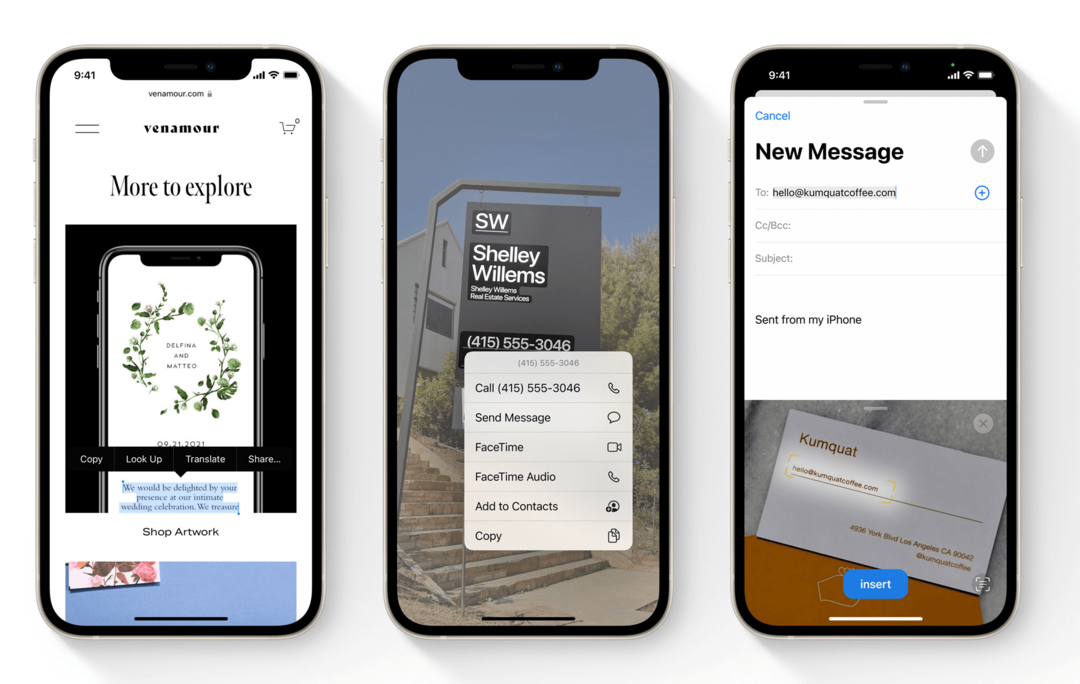

ฟีเจอร์แรกของ iOS 15 ที่ร้องว่า “Machine Learning!” สำหรับฉันคือข้อความสด ข้อความสดเป็นคุณสมบัติใน iOS 15 ที่ช่วยให้ iPhone ของคุณสามารถอ่านข้อความในแอพรูปภาพของคุณ

ซึ่งหมายความว่าคุณสามารถถ่ายภาพอะไรก็ได้ที่มีข้อความพิมพ์อยู่ เปิดรูปภาพนั้นในแอพรูปภาพ แล้วคุณจะสามารถโต้ตอบกับข้อความนั้นได้ คุณสามารถแตะที่หมายเลขโทรศัพท์ในรูปภาพ คัดลอกและวางข้อความจากรูปภาพของเอกสาร และใช้แถบค้นหาในแอพรูปภาพเพื่อค้นหาข้อความในรูปภาพ

คุณสมบัตินี้ยังช่วยให้ iPhone ของคุณสามารถอ่านลายมือในรูปภาพของคุณได้ มันใช้งานได้กับแอพกล้องเช่นกัน ดังนั้นคุณจึงสามารถโต้ตอบกับข้อความในช่องมองภาพของกล้อง iPhone ได้แบบเรียลไทม์

หากไม่มีแมชชีนเลิร์นนิง คุณลักษณะเช่นนี้แทบจะเป็นไปไม่ได้เลย นั่นเป็นเหตุผลที่การทดสอบความปลอดภัยออนไลน์เหล่านั้นใช้ข้อความที่บิดเบี้ยวเพื่อพิสูจน์ว่าคุณไม่ใช่หุ่นยนต์ เนื่องจากเป็นการท้าทายสำหรับโปรแกรมที่จะอ่านข้อความได้

ไม่เพียงแต่เป็นคุณสมบัติของสมาร์ทโฟนที่สามารถอ่านข้อความโดยไม่คำนึงถึงแบบอักษร สไตล์ สี หรือมุม แต่ยังมีประโยชน์อย่างมากในแบบเรียลไทม์ แต่ยังเป็นการใช้งานที่ยอดเยี่ยมของการเรียนรู้ของเครื่องมือถืออีกด้วย

คุณสมบัติของ iOS 15 จะทำให้ iPhone ของคุณรู้จักและระบุเนื้อหาในรูปภาพของคุณ

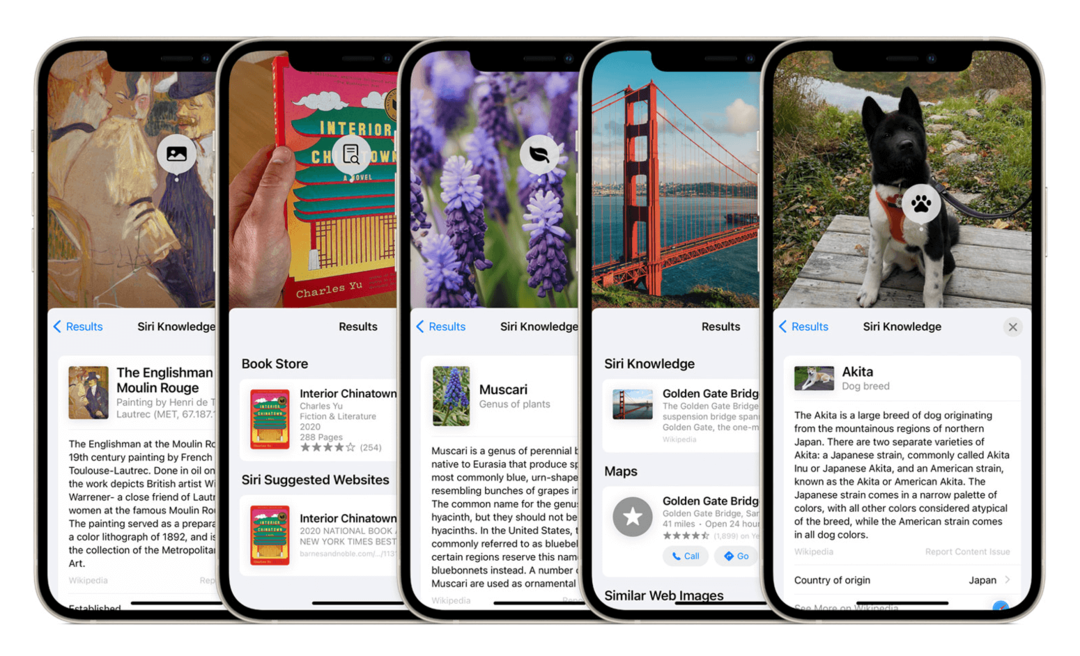

ฟีเจอร์ใหม่อีกอย่างของ iOS 15 ที่ใช้ Neural Engine คือการจดจำวัตถุในแอพรูปภาพ ฟีเจอร์นี้ทำงานคล้ายกับ Live Text ยกเว้นว่าจะรู้จักวัตถุมากกว่าข้อความ ตัวอย่างที่ Apple ใช้คือคุณสามารถเล็งกล้อง iPhone ของคุณไปที่สุนัข และ iPhone ของคุณจะไม่เพียงรับรู้ว่าเป็นสุนัข แต่ยังเป็นสุนัขสายพันธุ์ใดอีกด้วย

iPhone สามารถดึงใบหน้าออกจากรูปภาพของคุณมาระยะหนึ่งแล้ว ซึ่งเป็นรูปแบบหนึ่งของการจดจำวัตถุ แม้ว่าจะมีจำกัด การขยายความสามารถดังกล่าวจะช่วยให้ iPhone ของคุณดูข้อมูลที่ไม่มีโครงสร้างของภาพถ่ายและวัตถุประจำตัวได้อย่างรวดเร็ว

สิ่งนี้น่าประทับใจ (และยาก) มากกว่า Live Text เนื่องจากรูปแบบที่ Neural Engine ต้องมองหานั้นมีความสอดคล้องน้อยกว่ามาก iPhone ของคุณจะต้องตัดสินใจเป็นพันๆ (ถ้าไม่ใช่เป็นแสนๆ) เพื่อที่จะตัดสินใจแบบนั้นได้

การระบุสายพันธุ์สุนัข ก่อนอื่นต้องดูว่าสุนัขเป็นวัตถุที่แตกต่างจากพื้นหลัง จากนั้นจึงจำเป็นต้องวาดขอบเขตรอบๆ สุนัขตัวนั้น เลือกลักษณะเฉพาะของสุนัขตัวนั้นจนสามารถระบุได้ว่าเป็นสุนัขแล้วดึงลักษณะเฉพาะออกมาเพิ่มเติมเพื่อระบุว่าเป็นสุนัขประเภทใด เป็น.

การคำนวณแบบนั้นสามารถทำได้ด้วยตัวประมวลผลการเรียนรู้ของเครื่องเท่านั้น

ความทรงจำในรูปภาพจะดูซับซ้อนและให้ความรู้สึก "ของจริง" มากขึ้น

คุณสมบัติอื่นในแอพ Photos ที่จะได้รับ Neural Engine touchup คือ Memories

คุณลักษณะนี้จะถ่ายภาพในช่วงเวลาหนึ่ง (โดยปกติคือวันใดวันหนึ่ง) และรวมภาพเหล่านั้นไว้ในวิดีโอสั้นๆ เพื่อให้คุณดูได้ แนวคิดก็คือ Memories จะสร้างวิดีโอคอลลาจสำหรับวันหยุดพักผ่อน ปาร์ตี้ วันครบรอบ และอื่นๆ ของคุณโดยอัตโนมัติ

ความทรงจำเป็นอีกหนึ่งฟีเจอร์ของ iOS 15 ที่ได้รับคุณภาพที่เพิ่มขึ้นอย่างมาก มันจะรวมเพลงจากคลัง Apple Music ของคุณไว้ในความทรงจำของคุณโดยอัตโนมัติ

เพลงที่ Photos เลือกไม่เพียงแต่จะสอดคล้องกับวิดีโอเท่านั้น แต่ยังควรตรงกับเนื้อหาของวิดีโอด้วย ตัวอย่างเช่น รูปภาพจากปาร์ตี้ควรจับคู่กับเพลงที่มีพลัง ในขณะที่รูปภาพที่รอบคอบมากขึ้นควรมีเพลงที่ช้ากว่าแนบมาด้วย

แม้ว่าฉันจะไม่ได้ใช้คุณสมบัตินี้บ่อยนัก แต่วิทยาการคอมพิวเตอร์ที่อยู่เบื้องหลังคุณสมบัตินี้ช่างน่าทึ่งมาก รวมการจดจำวัตถุและทิวทัศน์ จัดกลุ่มภาพถ่ายตามเนื้อหา สถานที่ และช่วงเวลา แยกภาพถ่ายในแต่ละวันโดยเฉลี่ยออกจากภาพถ่ายที่เชื่อมโยงกับชีวิตพิเศษ เหตุการณ์ ดึงความเชื่อมโยงระหว่างอารมณ์ของภาพถ่ายเหล่านั้นกับอารมณ์ของเพลงที่คุณชอบ จับคู่ภาพเหล่านั้นในการนำเสนอแบบสไลด์โชว์ และเวลาการนำเสนอนั้นตามจังหวะของ ดนตรี.

ความทรงจำมักใช้ Neural Engine และ iOS เวอร์ชันถัดไปก็ถูกตั้งค่าให้เพิ่มความฉลาดของฟีเจอร์นี้อย่างมาก

การแจ้งเตือน วิดเจ็ต และห้ามรบกวนกำลังฉลาดขึ้น

การจัดกลุ่มคุณลักษณะ iOS 15 ที่ใช้ประโยชน์จาก Neural Engine มากขึ้น ได้แก่ การแจ้งเตือน วิดเจ็ต และห้ามรบกวน

วิดเจ็ตเริ่มใช้แมชชีนเลิร์นนิงใน iOS 14 แต่ฉันคิดว่ามันน่าจะมีประโยชน์ที่จะเพิ่มวิดเจ็ตเหล่านี้ที่นี่ Smart Stacks ช่วยให้คุณสามารถวางวิดเจ็ตไว้ด้านบนสุดของกันและกัน จากนั้น iPhone ของคุณจะพลิกดูตลอดทั้งวัน โดยแสดงให้คุณเห็นว่าเครื่องใดที่คิดว่าเป็นวิดเจ็ตที่มีความเกี่ยวข้องมากที่สุด ณ เวลาหนึ่งๆ

การตัดสินใจประเภทนี้ทำโดยการวิเคราะห์พฤติกรรมของคุณในช่วงเวลาต่างๆ ของวันและหลังจากใช้แอพบางตัว Neural Engine นำข้อมูลนี้ ตีความ จากนั้นแสดงวิดเจ็ตของคุณตามข้อมูลนี้

ฟีเจอร์ใหม่ของ iOS 15 ถูกตั้งค่าให้ทำงานคล้ายกันมาก

การแจ้งเตือนจะถูกจัดกลุ่มในสรุปการแจ้งเตือน ดังนั้นคุณจะไม่เห็นการแจ้งเตือนที่สำคัญน้อยกว่าที่หน้าจอล็อกของคุณหนาแน่นตลอดทั้งวัน คุณสามารถปรับแต่งคุณสมบัติสรุปการแจ้งเตือน หรือให้ Neural Engine จัดการให้คุณก็ได้

Do Not Disturb กำลังได้รับองค์ประกอบใหม่ Focus ซึ่งจะซ่อนการแจ้งเตือนบางอย่างตามวิธีการจัดหมวดหมู่ คุณสามารถจัดการโฟกัสด้วยตนเองหรือปล่อยให้จัดการเองอย่างชาญฉลาด

ฟีเจอร์ทั้งสามนี้จะใช้เมตริกแมชชีนเลิร์นนิงที่คล้ายกันมากในการทำนายและปรับให้เข้ากับพฤติกรรมของคุณ

ฟีเจอร์ใหม่ของ iOS 15 จะทำให้ขอเส้นทางด้วยกล้องของคุณได้ง่ายขึ้น

นี่เป็นหนึ่งในคุณสมบัติ iOS 15 ที่ฉันไม่เคยได้ยินความตื่นเต้นมากเท่าที่ฉันคาดไว้ ฉันยังพบว่าน่าสนใจมาก โดยเฉพาะอย่างยิ่งในบริบทการเรียนรู้ของเครื่อง

ใน Maps ใน iOS 15 คุณจะสามารถหันกล้องไปรอบๆ ขณะเดินได้ ที่จะช่วยให้คุณเห็นทิศทาง AR ที่ฉายในสภาพแวดล้อมของคุณ สมมติว่าคุณกำลังพยายามไปดูหนังและไม่แน่ใจว่าควรไปทางไหน คุณจะสามารถชี้ iPhone ของคุณไปรอบๆ และดูเส้นทางที่ไฮไลต์อยู่บนถนนและอาคารรอบ ๆ ตัวคุณ

เทคโนโลยี Augmented Reality บน iPhone เกิดขึ้นได้ด้วยการรวม Neural Engine ดังนั้นฟีเจอร์นี้จึงเป็นที่มาของการเรียนรู้ของเครื่อง แต่ฟีเจอร์นี้ยังรวม AR เข้ากับการจดจำภาพและการตรวจจับตำแหน่งเพื่อมอบประสบการณ์แบบเรียลไทม์ที่เหลือเชื่อ

แม้ว่าจะเปิดตัวในไม่กี่เมืองเท่านั้น แต่ฟีเจอร์นี้ชี้ให้เห็นถึงอนาคตที่แมชชีนเลิร์นนิงบน iPhone ไม่ได้ช่วยเหลือคุณในเบื้องหลังเพียงอย่างเดียว มันสามารถช่วยให้คุณบรรลุสิ่งต่าง ๆ ทันทีที่อยู่นอกเขตความสะดวกสบายหรือความสามารถของคุณ

Siri จะทำการประมวลผลบนอุปกรณ์ของคุณมากขึ้น

คุณลักษณะสุดท้ายของ iOS 15 ที่ใช้ประโยชน์จาก Neural Engine มากขึ้นคือ Siri Siri มักใช้การเรียนรู้ของเครื่อง แต่การเรียนรู้นั้นยังไม่ถึงขีดสุดของศักยภาพของ Neural Engine

นั่นเป็นเพราะ Siri ได้ใช้การประมวลผลนอกอุปกรณ์ นั่นหมายความว่า iPhone ของคุณรับฟังคำขอของคุณ แล้วส่งไปยังเซิร์ฟเวอร์ของ Apple ที่ประมวลผลคำขอ จากนั้นส่งกลับไปที่ Siri บน iPhone ของคุณเพื่อดำเนินการตามคำขอนั้น

เหตุผลนี้ก็คือการเพิ่มพลังของ Siri ให้เกินกว่าที่ iPhone จะรองรับได้ อย่างไรก็ตามใน iOS 15 สิ่งนี้ถูกตั้งค่าให้เปลี่ยนแปลง ตอนนี้ Siri จะทำการประมวลผลส่วนใหญ่บน iPhone ของคุณ นั่นน่าจะทำให้ Siri เร็วขึ้น ฉลาดขึ้น และน่าเชื่อถือมากขึ้น

ฉันคิดว่าการอัปเดตนี้อาจต้องการความช่วยเหลือน้อยที่สุดจาก Neural Engine ดังนั้นการจัดวางที่ส่วนท้ายของรายการ อย่างไรก็ตาม เป็นที่น่าสังเกตว่า เนื่องจากชี้ว่า Siri เริ่มฉลาดขึ้น ผู้ช่วยที่มีความสามารถมากขึ้นโดยใช้ฮาร์ดแวร์บน iPhone ไม่ใช่เซิร์ฟเวอร์ที่อยู่ห่างไกล

Neural Engine สามารถทำอะไรได้บ้างหากไม่มีฟีเจอร์ iOS 15 ที่กำลังจะมีขึ้น

และนั่นแหล่ะ! เท่าที่ฉันสามารถบอกได้ นั่นคือวิธีใหม่ๆ ที่ฟีเจอร์ iOS 15 จะเริ่มใช้พลังดิบของ Neural Engine

ฉันต้องการรวมส่วนสั้น ๆ ไว้ที่ส่วนท้ายของโพสต์นี้โดยเน้นถึงบางสิ่งที่ Neural Engine ทำบน iPhone ของคุณแล้ว ด้วยวิธีนี้ คุณจะเปรียบเทียบได้ว่าวันนี้ที่ไหนกับอีกไม่กี่เดือนข้างหน้า

หวังว่านี่จะช่วยให้คุณซาบซึ้งกับการเปลี่ยนแปลงที่จะเกิดขึ้นกับ iOS ในรูปแบบใหม่และเข้าใจได้ดีขึ้นว่าฟีเจอร์เช่นนี้มากับ iPhone ของคุณอย่างไร

Neural Engine ช่วยให้คุณถ่ายภาพได้ดีขึ้น

ฉันจะบอกว่าการใช้ Neural Engine บน iPhone ครั้งใหญ่ที่สุดนับตั้งแต่ปี 2017 คือการถ่ายภาพ ทุกๆ ปี Apple จะแสดงให้เห็นว่า iPhone รุ่นใหม่ล่าสุดจะสามารถคำนวณด้วยภาพถ่ายได้มากกว่ารุ่นก่อนๆ ได้อย่างไร Apple กล่าวว่า "ตัวประมวลผลภาพทำการคำนวณ/ตัดสินใจ X ล้านครั้งต่อภาพ"

หมายถึงจำนวนการคำนวณที่ Neural Engine ทำทุกครั้งที่คุณถ่ายภาพ โดยจะพิจารณาจากสี แสง องค์ประกอบที่ตัดกัน ตัวแบบ พื้นหลัง และปัจจัยอื่นๆ มากมาย และจะกำหนดวิธีการให้คะแนน ปรับแต่ง ดูดซับ และปรับสมดุลองค์ประกอบเหล่านี้ให้สมดุลในทันที

กระบวนการเรียนรู้ด้วยเครื่องนี้ทำให้สิ่งต่างๆ เช่น โหมดแนวตั้งและ Deep Fusion เป็นไปได้ โหมดภาพถ่ายบุคคลสามารถแยกคุณออกจากพื้นหลังได้ และ Deep Fusion ทำให้การถ่ายภาพกลางคืนบน iPhone ดีขึ้นกว่าเดิมอย่างมาก

Neural Engine มีความสำคัญต่อกล้องของ iPhone เนื่องจากข้อจำกัดด้านฮาร์ดแวร์ เนื่องจากขนาดของ iPhone กล้องและเลนส์จึงถูกจำกัดความสามารถ มันคือคอมพิวเตอร์และแมชชีนเลิร์นนิงที่เกิดขึ้นเมื่อคุณถ่ายภาพที่ทำให้การถ่ายภาพด้วย iPhone ของคุณเทียบเท่ากับภาพถ่ายจาก DSLR ระดับมืออาชีพ

การเรียนรู้ของเครื่องทำให้ FaceID รวดเร็ว ปลอดภัย และปรับเปลี่ยนได้

แน่นอน เราไม่สามารถพูดถึง Neural Engine ได้โดยไม่เอ่ยถึงเหตุผลที่สร้างมันขึ้นมา

ใช่แล้ว – มีการเพิ่ม Neural Engine ใน iPhone X เพื่อให้ FaceID เป็นไปได้ ในกรณีที่คุณไม่ทราบ FaceID เป็นหนึ่งในคุณสมบัติที่ซับซ้อนและซับซ้อนที่สุดของ iPhone ของคุณ

FaceID ไม่เพียงแต่เปรียบเทียบภาพ 2D ของใบหน้าของคุณในกล้องเซลฟี่กับภาพ 2D อื่นของใบหน้าของคุณ โดยจะดูแผนที่ 3 มิติของใบหน้าของคุณ ติดตามการเคลื่อนไหวของดวงตา และเปรียบเทียบกับการสแกนใบหน้า 3 มิติก่อนหน้าของคุณ

FaceID ไม่ได้ทำเพียงแค่ในเวลาไม่ถึงสองวินาทีในขณะที่ใบหน้าของคุณกำลังเคลื่อนไหว ถูกบดบังบางส่วน และในมุมที่แตกต่างกัน นอกจากนี้ยังปรับให้เข้ากับลักษณะที่ใบหน้าของคุณเปลี่ยนแปลงไปในแต่ละวันอย่างละเอียดอีกด้วย นั่นคือเหตุผลที่คุณสามารถไว้หนวดเครา แก่ขึ้น และเปลี่ยนแปลงด้วยวิธีอื่นๆ ได้โดยไม่ต้องสแกนใบหน้า

FaceID และ Neural Engine กำลังศึกษาและเรียนรู้จากใบหน้าของคุณทุกครั้งที่คุณปลดล็อก iPhone หากไม่มี Neural Engine FaceID จะไม่เร็ว ปลอดภัย หรือเชื่อถือได้เพียงครึ่งเดียวเหมือนในทุกวันนี้

Neural Engine มีบทบาทสำคัญในประสบการณ์ AR บน iPhone

ในที่สุด Neural Engine ก็มีบทบาทสำคัญใน AR บน iPhone สำหรับผู้ที่ไม่ทราบ Augmented Reality (AR) เป็นฟีเจอร์ที่ฉายโมเดล 3 มิติในสภาพแวดล้อมของคุณผ่านช่องมองภาพของกล้อง iPhone คุณสามารถทดสอบได้ด้วยตัวเองโดยใช้แอพ Measure บน iPhone ของคุณ

คุณลักษณะประเภทนี้รวมสิ่งต่างๆ เช่น การจดจำภาพ การรับรู้พื้นที่ และหน่วยความจำ ทั้งหมดนี้ต้องการพลังที่ Neural Engine นำมาสู่โต๊ะ

โชคดีที่คุณสมบัติใหม่มากมายของ iOS 15 ได้รับการตั้งค่าให้ AR บน iPhone มีประสิทธิภาพมากยิ่งขึ้น เป็นเทรนด์ที่ฉันหวังว่าจะดำเนินต่อไป เนื่องจากฉันคิดว่า AR มีศักยภาพที่จะเป็นหนึ่งในคุณสมบัติที่สำคัญที่สุดของอุปกรณ์มือถือ

ฟีเจอร์ iOS 15 ที่กำลังจะมาถึงชี้ไปที่อนาคตอันชาญฉลาดสำหรับ iPhone

โดยรวมแล้ว ฉันตื่นเต้นมากสำหรับอนาคตที่ฟีเจอร์ iOS 15 เหล่านี้จะให้เราได้เห็น มีหลายแง่มุมของ iPhone ที่รู้สึกว่าใช้งานไม่ได้เล็กน้อย แต่มีน้อยเท่ากับ Neural Engine ที่เคยเป็นมา ฉันหวังว่าการเปลี่ยนแปลงนี้และหวังว่าคุณจะทำเช่นกัน!

สำหรับข่าวสาร ข้อมูลเชิงลึก และเคล็ดลับเพิ่มเติมเกี่ยวกับทุกสิ่งที่ Apple โปรดดูส่วนที่เหลือของ บล็อก AppleToolBox!