Como todos los lanzamientos de iPhone hasta ahora, el iPhone XS y el iPhone XS Max de este año tienen cámaras mejoradas. Pero no son mejores de la forma que cabría esperar.

Sobre el papel, el iPhone XS y el iPhone XS Max no parecen tener cámaras con especificaciones significativamente mejoradas en comparación con el modelo insignia del año pasado.

Pero aún tomarán mejores fotos y videos que el iPhone X. Este es el por qué.

Contenido

- RELACIONADO:

- Actualizaciones de hardware para el iPhone XS

-

Actualizaciones de software clave para la cámara del iPhone XS

- Smart HDR de Apple para iPhone XS y XR

- Actualización del modo retrato

- Artículos Relacionados:

RELACIONADO:

- Nuestras primeras impresiones de los modelos de iPhone 2018

- Los 25 mejores consejos de iOS 12 que realmente funcionan

- ¿Qué pasó con Airpower? Cobertura exclusiva

- Aquí está todo lo que Apple no anunció en el evento de este año y lo que podría significar

Actualizaciones de hardware para el iPhone XS

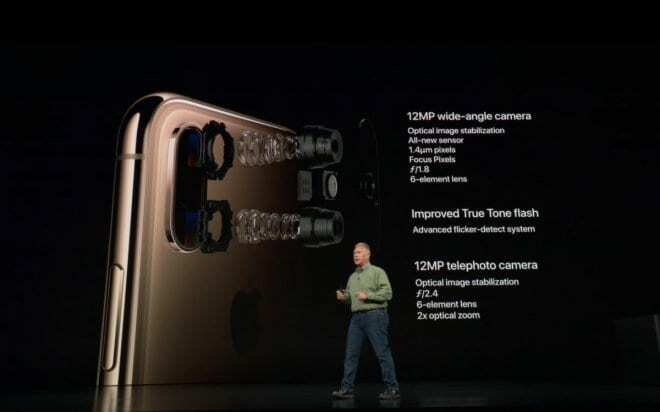

Para ser claros, Apple aún ha actualizado el hardware de la cámara real en los nuevos iPhone Xs y iPhone Xs Max. Eso incluye una actualización de la cámara trasera.

Si bien sigue siendo un sensor de 12 megapíxeles con una lente f / 1.8 estabilizada ópticamente, Apple ha aumentado el tamaño del sensor y los megapíxeles

- Eso significa que pueden recolectar más luz y, como resultado, pueden tomar fotos con mejor apariencia.

- La cámara frontal incluye el mismo sensor de 7 megapíxeles con una lente f / 2.2. (Aunque el sensor ahora es "el doble de velocidad", según Apple).

- La cámara con teleobjetivo orientada hacia atrás aún cuenta con un sensor de 12 megapíxeles, una lente f / 2.4 y estabilización óptica de imagen.

- Apple también dice que ha actualizado gradualmente el ya excelente flash True Tone. Esa actualización debería permitir una reproducción del color más precisa en condiciones de poca luz.

Actualizaciones de software clave para la cámara del iPhone XS

Además de las actualizaciones de hardware, también hay varias actualizaciones basadas en software. Estas actualizaciones, como los nuevos algoritmos de estabilización de video, generalmente mejorarán la calidad de las fotos.

Pero cuando se trata de cambios significativos en la parte frontal de la cámara del iPhone XS y del iPhone XS Max, se reduce principalmente a dos nuevas características principales.

Smart HDR de Apple para iPhone XS y XR

Pero, con mucho, la mayor actualización del sistema de la cámara en el iPhone XS y XS Max tiene poco que ver con los sensores y los megapíxeles. En cambio, se basa principalmente en software.

El nuevo sistema se llama Smart HDR

Es un sistema de software que aprovecha el A12 Bionic de alto rendimiento de Apple. Básicamente, ejecuta las fotos que toma a través de un procesador de señal de imagen actualizado y el motor neuronal del A12 para que se vean mejor.

El proceso real es más complicado que eso, por supuesto. Smart HDR funciona como sistemas similares en otros dispositivos y cámaras. Toma una serie de imágenes con diferentes exposiciones y las combina de manera inteligente para crear una sola imagen que se ve mucho mejor.

Como resultado, sus imágenes serán de alta calidad incluso en situaciones de poca luz. En comparación con los dispositivos que no están equipados con Smart HDR, generalmente también serán más brillantes y tendrán muchos más detalles.

Ayudado por la fotografía computacional

Apple llama a esta tecnología "fotografía computacional", es decir, fotografía asistida por un poder de procesamiento de alta tecnología como el A12 Bionic. Basta decir que este tipo de sistema simplemente no es posible sin un silicio de primer nivel como el A12.

De hecho, es bastante sorprendente cómo funciona Smart HDR. Tan pronto como abre la aplicación Cámara, el iPhone XS / XR comienza a tomar un "búfer de cuatro cuadros" que permite un retardo de obturación cero.

Smart HDR luego observará estos marcos y decidirá si pueden mejorar una foto agregando detalles. También detecta de forma inteligente el movimiento o los rostros dentro de una toma y adapta el resultado final en consecuencia.

Entonces, esencialmente, el chip A12 Bionic de Apple toma una foto y la hace lucir mejor en el mismo instante en que la tomas. Esa es una función que incluso las cámaras de fotograma completo no pueden hacer, aunque pueden tomar fotos de mayor calidad.

Actualización del modo retrato

Apple ha realizado un cambio basado en software similar al modo vertical, que es la función patentada que permite a los usuarios tomar una imagen con un "efecto bokeh" simulado similar a las fotos tomadas con una cámara de fotograma completo.

Bokeh es un término que se usa para describir una imagen con un sujeto resaltado y un fondo suavemente borroso. Es solo una de las formas en que las imágenes de la cámara de un teléfono inteligente se pueden hacer para que parezcan algo tomadas con una DSLR o una cámara sin espejo de fotograma completo.

Un cambiador de juegos para dispositivos móviles: ajuste manual del bokeh

Pero el iPhone XS, el iPhone XS Max y el iPhone XR hacen algo interesante. Te permite ajustar el desenfoque del fondo o el bokeh después de tomar la imagen.

Funciona detectando un rostro en una amina y separando el fondo y el primer plano. El software de Apple también creará un "mapa de profundidad" del entorno, agregando inteligentemente desenfoque para imitar cómo se vería la imagen en una DSLR.

Apple ha hecho esto modelando el desenfoque del modo retrato en cámaras de fotograma completo con lentes desmontables. Claro, la calidad de imagen no es directamente comparable, pero la línea iPhone XS (y XR) funciona excepcionalmente bien para un teléfono.

Vale la pena señalar que algunos otros dispositivos, como algunos de Samsung, han tenido características similares antes de Apple. Pero el sistema de control de profundidad de Apple generalmente se verá mejor porque trabaja más en segundo plano con su procesamiento de imágenes.

Además, la función también está disponible en la cámara frontal a pesar de que solo tiene un sensor.

Mike es un periodista independiente de San Diego, California.

Si bien cubre principalmente Apple y tecnología de consumo, tiene experiencia en escribir sobre seguridad pública, gobierno local y educación para una variedad de publicaciones.

Ha ocupado varios puestos en el campo del periodismo, incluido el de escritor, editor y diseñador de noticias.