Durante il Google I/O 2019, Google ha annunciato 3 nuove API in ML Kit e l'estensione di Firebase Performance Monitoring per gli sviluppatori web.

La piattaforma di sviluppo mobile di Google, Firebase, riceverà il suo più grande aggiornamento quest'anno alla conferenza annuale degli sviluppatori di Google, Google I/O. Oggi Google ha annunciato nuovi modi per migliorare l'accessibilità dell'apprendimento automatico per gli sviluppatori; Google sta inoltre estendendo i suoi strumenti di monitoraggio delle prestazioni per aiutare gli sviluppatori web ad accelerare le loro app web.

Google ha annunciato il kit ML all'I/O dell'anno scorso per svelare il mistero dell'apprendimento automatico per gli sviluppatori. Hanno iniziato con un paio di API per i casi d'uso più comuni e quest'anno stanno espandendo l'SDK con l'aggiunta di 3 nuove API: un'API sul dispositivo per la traduzione, un'API per il rilevamento e il tracciamento degli oggetti e un'API per creare facilmente ML personalizzato Modelli. Gli sviluppatori di app native possono integrare Performance Monitoring SDK nella propria app per raccogliere dati sulle prestazioni che possono poi analizzare in Firebase Performance Monitoring; presto, gli sviluppatori web saranno anche in grado di monitorare le prestazioni delle loro app web in Firebase. Ho parlato con Francis Ma, responsabile del prodotto presso Firebase, per saperne di più su questi cambiamenti.

Nuove API del kit ML

L'SDK ML di Google supporta attualmente 7 API: riconoscimento del testo, rilevamento dei volti, scansione dei codici a barre, etichettatura delle immagini, riconoscimento dei punti di riferimento, risposta intelligente e identificazione della lingua. Gli ultimi 2 erano solo recentemente aggiunto in aprile, ma ora ad essi si aggiungeranno le 3 API sopra menzionate. Ecco un riepilogo di alto livello delle 3 nuove API ML per gli sviluppatori:

- API sul dispositivo per la traduzione: utilizzando lo stesso modello che alimenta la traduzione offline dell'app Google Translate, questa nuova API consente agli sviluppatori di fornire traduzioni veloci e dinamiche tra 58 lingue.

- API di rilevamento e tracciamento degli oggetti: questa API consente a un'app di individuare e tracciare l'oggetto più importante, contrassegnato da un riquadro attorno ad esso, in un feed della telecamera in tempo reale. Gli sviluppatori possono quindi identificare l'oggetto più importante eseguendo una query su un'API di ricerca di Cloud Vision. Ad esempio, si dice che IKEA stia sperimentando questa API per l'acquisto di mobili visivi.

- AutoML Vision Edge: per gli sviluppatori che desiderano un modello ML personalizzato con competenze minime necessarie, AutoML Vision Edge consente di creare e addestrare il proprio modello personalizzato da eseguire localmente sul dispositivo di un utente. Per addestrare un modello, uno semplicemente carica il loro database (per esempio. una serie di immagini) alla console Firebase e fai clic su "train model" per addestrare un modello TensorFlow Lite rispetto al database. Google ha annunciato che una società chiamata Fishbrain ha utilizzato questa API per addestrare un modello in grado di identificare la razza di un pesce, mentre un'altra società chiamata Lose It! ha addestrato un modello a identificare le categorie di cibo in un'immagine.

L'apprendimento automatico è un campo in rapida crescita nell'informatica, quindi è naturale che gli sviluppatori mostrino interesse nei suoi confronti. Tuttavia, è possibile creare e formare modelli ML in modo efficace senza un data scientist nel personale difficile, motivo per cui Google sta semplificando il processo automatizzando l'addestramento dei modelli con Kit ML. Gli sviluppatori possono concentrarsi sulla creazione di nuove app con funzionalità potenti sfruttando la potenza del machine learning senza dover dedicare tempo e sforzi significativi all'apprendimento della scienza dei dati. Con l'aggiunta di queste 3 nuove API in ML Kit, speriamo di vedere molte nuove app utili su Google Play.

Monitoraggio delle prestazioni Firebase per sviluppatori Web

I consumatori richiedono buone prestazioni dalle app e dai siti Web che utilizzano, ma finora Firebase ha fornito solo agli sviluppatori di app native i mezzi per monitorare efficacemente le prestazioni dei propri prodotti. Al Google I/O 2019, Google ha annunciato che Firebase Performance Monitoring sarà reso disponibile per gli sviluppatori web che lo utilizzano Hosting Firebase. Gli sviluppatori web possono mantenere gli utenti coinvolti sulle loro piattaforme migliorando la velocità delle loro app web; Per aiutare gli sviluppatori web a individuare i principali punti deboli nelle prestazioni dei loro siti, Firebase fornirà strumenti incentrati sul web e misurazioni di telemetria per mostrare come gli utenti del mondo reale sperimentano un sito web. Ad esempio, gli sviluppatori web saranno in grado di monitorare aspetti come il tempo necessario per dipingere per la prima volta e il ritardo di input, quanto presto le persone vedono e interagiscono per la prima volta con il contenuto di una pagina web e la latenza media. La dashboard panoramica mostrerà queste e altre metriche per aiutare gli sviluppatori web a ottimizzare l'esperienza per i propri utenti, sia per paese che a livello globale.

Altri annunci

Generatore di segmenti di pubblico aggiornato in Google Analytics per Firebase

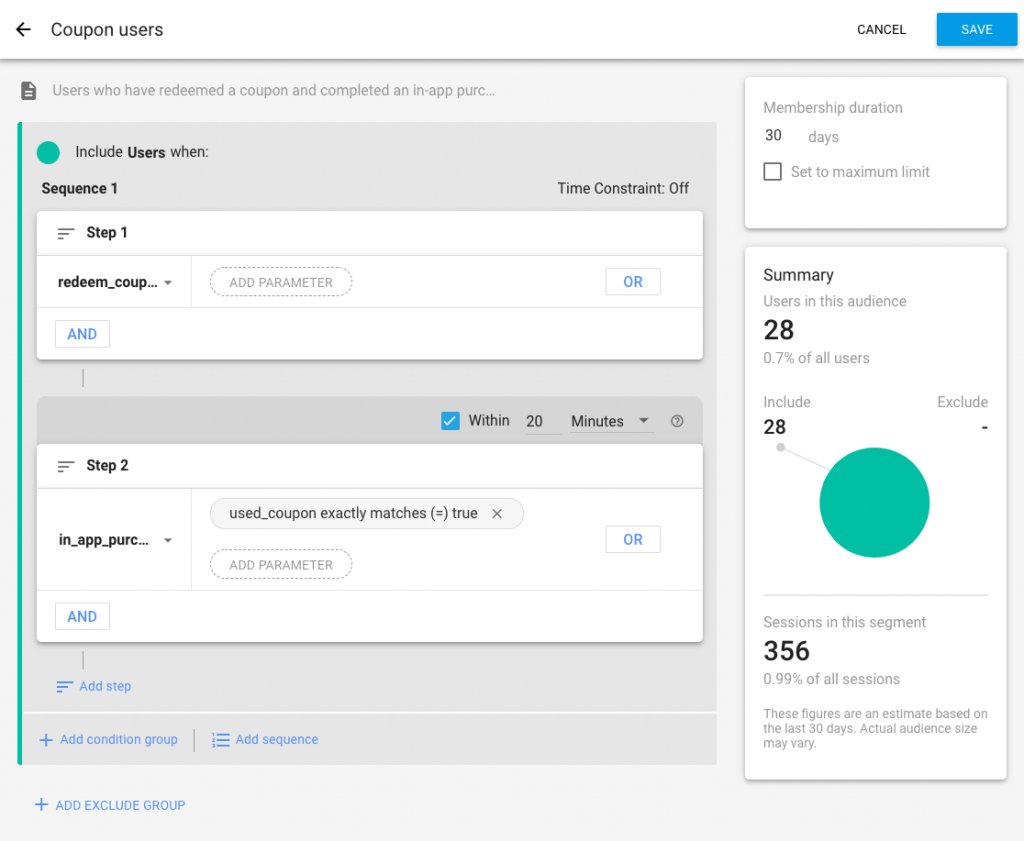

Costruire un pubblico mirato è fondamentale per massimizzare il coinvolgimento degli utenti. Vuoi assicurarti di segmentare i tuoi utenti nelle categorie giuste in modo da sapere come targettizzare al meglio con incentivi e incoraggiamenti personalizzati in modo che siano più propensi a continuare a utilizzare la tua app o servizio. Google Analytics per Firebase aiuta gli sviluppatori a comprendere meglio i propri utenti e i suoi generatore di pubblico aggiornato semplificherà la creazione di nuovi segmenti di pubblico da raggiungere come target Configurazione remota o reimpegno attraverso Messaggistica in-app. Le funzionalità aggiornate del generatore di pubblico includono funzionalità come "sequenze, ambito, finestre temporali e [e] durata dell'iscrizione". Come esempio, Google afferma che ora è possibile creare un pubblico per gli utenti che riscattano un codice coupon e acquistano un prodotto entro 20 minuti dal coupon redenzione.

- Cloud Firestore, un database NoSQL completamente gestito, ottiene il supporto per Query sul gruppo di raccolta che consente alla tua app di "cercare campi in tutte le raccolte con lo stesso nome, indipendentemente da dove si trovano nel database". Le query del gruppo di raccolta verranno ad esempio, consentire a un'app musicale con una struttura dati composta da artisti e relativi brani di eseguire query tra gli artisti per i campi nei brani indipendentemente dal artista.

- Il nuovo Emulatore di funzioni cloud consentirà agli sviluppatori di accelerare lo sviluppo e il test delle app locali; comunica con l'emulatore Cloud Firestore.

- Se devi eseguire il debug degli arresti anomali nella tua app, Firebase Crashlytics può aiutarti a diagnosticare eventuali problemi di stabilità. L'avviso di velocità ti dice quando un particolare problema è improvvisamente aumentato di gravità e vale la pena esaminarlo, ma la sua soglia di avviso non è mai stata personalizzata fino ad ora.

Per ulteriori notizie su Firebase, resta sintonizzato su blog ufficiale o unisciti a Alfa programma per ottenere un'anteprima delle funzionalità imminenti.